第13回 映像編集ソフトウェア DaVinci Resolve

これまでの連載で頻繁に登場した、総合的な映像編集ソフトウェア『DaVinci Resolve』。現在のメジャーバージョンは18まで進んでいますが、これまでどのように進化してきたのかは、あまり知られていないでしょう。そこで、DaVinciの生い立ちと、私が接してきた経験を合わせて、その歴史を振り返ってみましょう。

今年で38歳。DaVinci Resolveの生い立ち

初期のDaVinci Resolve操作画面

パラメータ設定のための表示で、高精細なビューワは見当たらない。タイムラインのような部分と、静止画を含んだメモリのようなインターフェースがうかがえる。

DaVinci Resolveの歴史は、1982年にアメリカフロリダ州のハリウッドではじまりました。この地は、西海岸のハリウッドと間違えそうですが、フロリダ半島にあるマイアミエリアの主要都市です。ここにポストプロダクションのVideo Tape Associates社(VTA)があり、その社内でのみ使うためのクローズドなシステムとして誕生しました。この生まれたばかりのカラーコレクションシステムは、DaVinciではなくWizと命名されます。当時のカラーコレクションシステムは、フィルムからビデオに変換する際のテレシネスタジオで使用されるため、Wizはフィルム機器とのインターフェースを備えていました。

この時点ですでに、プライマリーとセカンダリーカラーコレクションを搭載していて、その後の進化の原点となっています。1984年にVTA社の研究開発部門から独立して、da Vinci Systemsという社名でパブリックに開発がスタートします。ここではじめてDaVinci(ダヴィンチ)の名前が登場します。これは、今から38年前(1984年)のことです。

初期モデルはda Vinci Classicとして、メジャーなテレシネシステムと連携して評価を高めていきます。その後、コントロールパネルにトラックボールを追加。1990年代になり映像システムにSDIが採用される頃、DaVinciもデジタル化されます。ソフトエッジをサポートしたパワーウィンドウ、カスタムカーブ、輝度とクロマを独立して調整できる機能などがこの時点で実装されていました。

2008年にリリースされたImpresarioコントロールパネル。トラックボールの滑らかさは、今でも評価は高い。

1998年、DaVinci 2Kの登場でHSDL(High Speed Data Link)をサポートして、テレビ信号に加えて映画向けのデータ処理へ進んでいきます。ちょうどこの頃には、業界でもデジタルでカラーコレクションを行うデジタル・インターミディエイトにワークフローがシフトして、フィルムが姿を消す流れへと進んでいきました。デジタル・インターミディエイトとは、従来のフィルムだけでの制作フローから、撮影と上映以外の工程をデジタル化した新しい手法を言います。入口と出口はフィルムを使い、それに挟まれた主にポストプロダクション工程を完全デジタル化したことで、複雑な映像合成がたくさんの映画の中で活用されるようになっていきます。DaVinciは、ここまでの間にいくつかの開発オーナーを移り変わってきており、2009年に現在のBlackmagic Design社に買収されています。

ここまでは、テレビ信号のためのカラーコレクションシステムという、大規模な設備を要するポストプロダクションでしか使用できない特殊なツールでした。私が初めてDaVinciを目にしたのは、1992年頃だったと記憶しています。ポスプロのスタジオ内に居座っていたDaVinciは、大きな電子基板が剥き出しの無骨で大きな筐体でした。小型の冷蔵庫と同じくらいのその本体からは、今のソフトウェアベースの高機能さは伺えませんでした。当時の本体価格は1億円近くすると聞いて、バブル経済の余韻を感じたことを憶えています。Blackmagic Design社によって後年、誰でも自由に使うことができる高機能なソフトウェアに進化したわけですが、DaVinciの中に育まれていた色処理に対するこだわりは、生まれた頃から現在まで一貫しているように私には見えます。

なぜ、レガシー・カラーサイエンスでは足りないか?

1984年に生まれてから少し前までは、DaVinciが前提としていた対応フォーマットは、テレビ信号と一部の映画規格でした。デジタルシネマカメラの定着によって、撮影時の色域やガンマ特性は単一の規格では対応できないようになっていきました。カメラメーカーは自社の製品の特徴を色濃く出すために、独自の特性を開発しました。これによって、DaVinci Resolveなどの後処理で使用されるソフトウェアでは、カメラの機種ごとの入力プロファイルを用意する必要が出てきました。さらに、完パケのフォーマットはスタンダードなテレビ規格に加えて、デジタルシネマや、デジタルサイネージなどの独自規格、そしてYouTubeを筆頭とするWeb向けのコンテンツなど、出力先のフォーマットも増え続ける傾向にあります。

BT.709だけをカバーしていれば良かったDaVinci Resolveにおいても、さまざまなフォーマットへの対応が急務となり、バージョン12においてこれに向けた機能追加が行われ、新しいカラーサイエンスであるResolve Color Managed、通称RCMが登場しました。従来のカラーサイエンスは、テレビモニターを最終出力とするディスプレイ・リファードのDaVinci YRGBでした。RCMはシーン・リファード対応のカラーサイエンスです。

これは私の個人的な見解ではありますが、レガシーなDaVinci YRGBでは、内部処理はRGBのコードバリューだけを維持するような、一般的な画像処理に似た演算処理ではなかったかと考えています。そのスペックで十分だったからです。これに対してRCMでは撮影場所の光をシミュレーションするシーン・リファードに対応するために、RGBコードバリューだけでは十分ではなく、入力ソースごとのプロファイルが必要になります。その結果、DaVinci Resolveの内部処理はRGBコードバリューではなく、XYZの値を維持するようになったと私は理解しています。個人的にBlackmagic Design社のエンジニアに聞いたところでも、そのような回答を得ています。

SDR(BT.709)だけを前提としていた、レガシーなDaVinci ResolveのカラーサイエンスがDaVinci YRGBです。バージョンアップによってDaVinci YRGBの対応フォーマットは拡大し、SDRだけではなくなってはいますが、HDRなど今後の新しいフォーマットへの対応にはRCMを使用することを私は推奨しています。RCMが物理的な光をシミュレーションできるシーン・リファードに対応している背景には、どんな技術があるのかを見てみましょう。

人が感じる光をモデル化した映像表現とは

前項でXYZというキーワードが登場しましたので、物理的な光をデジタルデータに数値化する際の、技術的な背景を確認しておきましょう。

テレビや映画などをはじめ、私たち人間が視覚から得る情報には個人差があります。色の判断能力は、性別や個人の経験によるところで違いが現れます。しかし、私たちが生活をする中で目にするものの色には、統一感や厳格に決められたルールが必要です。信号機や道路標識などが、見る環境によって異なるようなことがあると問題になってしまいます。現在利用されている色に関する規格は、1931年に国際照明委員会(CIE)が発表したものをベースにしています。

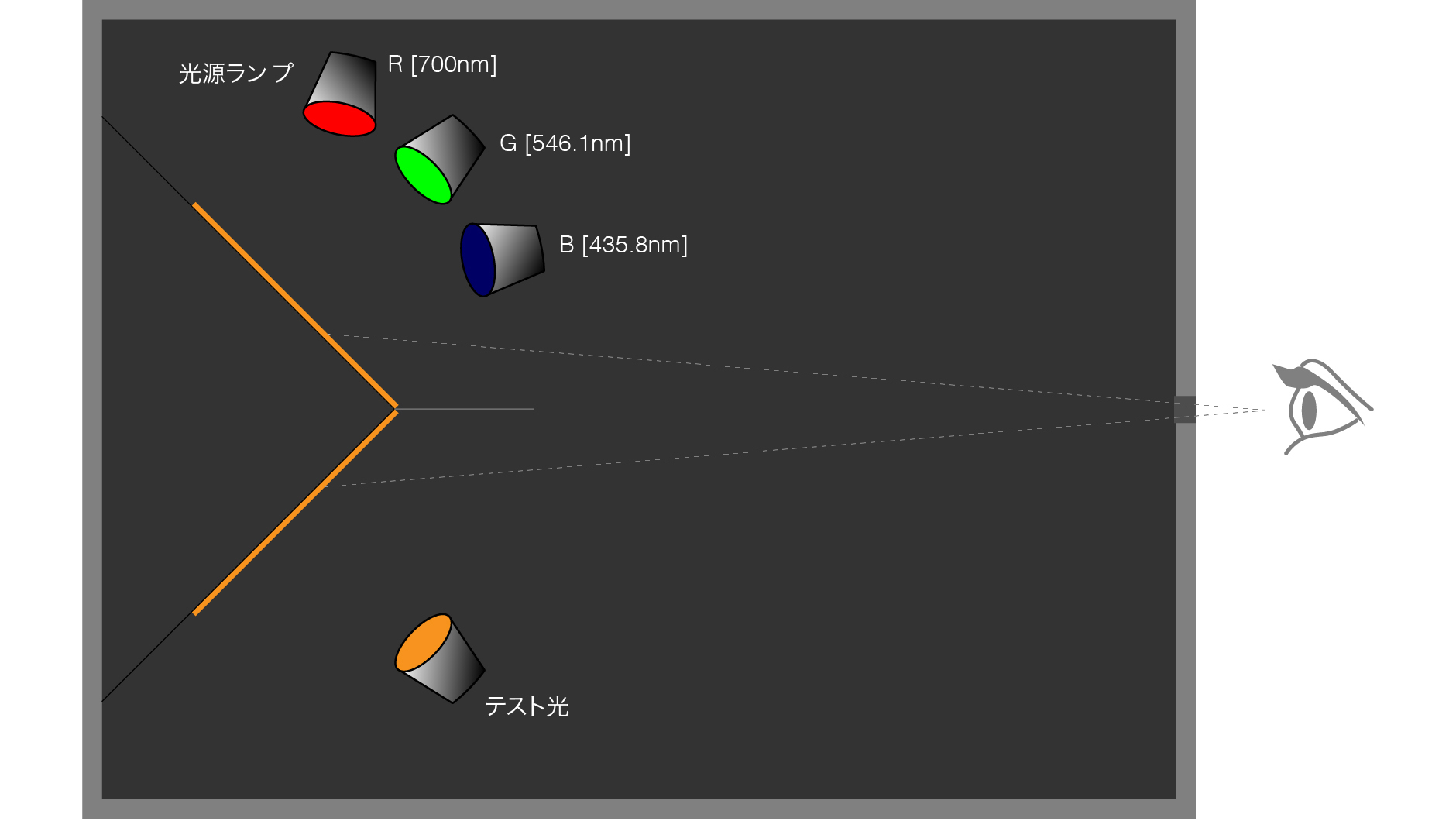

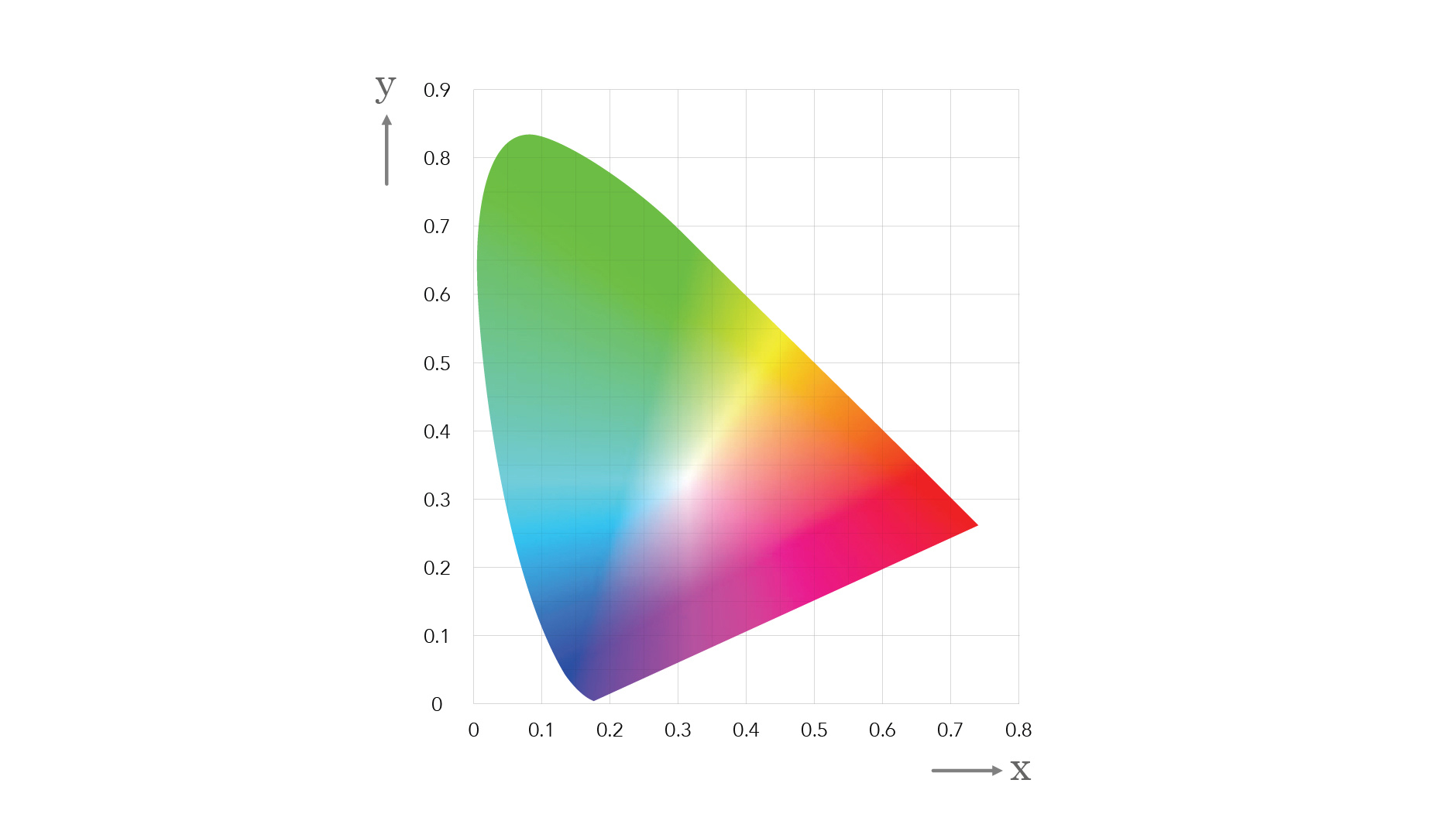

上図のような装置を使って、被験者に見える光の色がテスト光と一致するように、三つの光源の強弱を調整します。この実験をさまざまな色で、そしてたくさんの被験者を対象に行い、一般的な人間のモデルとなる色の特性ができたのです。実験の時に使用された三つの光源は数学的な処理を加えて、XYZの三つの要素に規定され、光の三刺激値と呼ばれます。大文字のXYZは、物理的な光を表現するときの要素になります。この三つの要素を表現するため、立方体のようなモデルになります。しかし直感的に色の違いを把握するために、立方体のような三次元ではなく縦横の二次元のグラフにしたいと考えました。そこでXYZから小文字のxyzを導いて、xとyだけを使って平面で表現できるグラフができ上がりました。これがよく目にするCIEのxy色度図です。(当連載第4回macOSとColorSyncでも解説)

このxyをベースにしたXYZの値をDaVinci Resolveでは内部処理で使用しているのだと私は理解しています。これによって、どのようなRGBやYUVデータが入力されても、それにペアになった光に変換するためのプロファイルがあれば、XYZ空間に展開できるようになります。このプロファイルが、カラースペースとガンマです。DaVinci ResolveのRCMでは入力カラースペース設定がありますが、これは素材ごとにプロファイルを指定するためにユーザーの意思でセットするためのパラメータです。このように、撮影やCGでレンダリングした素材などのDaVinci Resolveから見た入力ソースには、RGB/YUVコードバリューに加えて、それらを光の空間に展開するためのプロファイル(カラースペース+ガンマ)が欠かせないのです。

XYZをカバーするRCMだから、HDRを表現できる

シーン・リファードに対応したRCM(Resolve Color Managed)では、取り込んだ素材のRGB/YUVコードバリューに加えて、光の空間XYZへの変換するためのプロファイル(カラースペースとガンマ)が必要であると説明しました。このように、RCMでは物理的な光をシミュレーションするので、最大値100cd/m2のような上限に縛られることはありません。RCMはレガシーなDaVinci YRGBを内包するような関係性にあるので、現在のDaVinci Resolve最新版では、DaVinci YRGBでもある程度のHDRフォーマットのプロジェクトは処理できるかもしれません。第12回記事ではRCMのみがHDRに対応していると書きましたが、技術的には誤解を招く記載になってしまっていたかもしれません。ただし、私が考える現実的なDaVinciの使い方では、さまざまなフォーマットに対して臨機応変に切替えがしやすいRCMがおすすめなため、HDRプロジェクトではRCMを使用することを強く推奨します。

一般的なPCベースで使用する動画編集アプリケーションは、RGBやYUVのコードバリューを処理するディスプレイ・リファードが大半だと思います。この点が、DaVinci Resolveを一歩進んで使用する際には取っ付きにくい点と思われるのではないでしょうか。撮影シーンの光を基点として、カメラはレンズを通してその光をキャプチャーし、RAW/Logでエンコードすることでメディアファイルが作成されます。そのメディアファイルをDaVinci Resolveに取り込む際に、光をシミュレーションするRCMを使用するのなら、プロファイル(カラースペースとガンマ)を加えて処理をします。DaVinci Resolveからの出力は、SDRやHDR各種の規格などを柔軟に切替えることが容易です。このRCMワークフローが、DaVinci Resolveを使用する際の最も大きなアドバンテージになると言えます。

さらに、DaVinci Resolveと同時にビデオI/Oを使用し、ColorEdgeなどのリファレンスモニターを精度高く活用することで初めて正確なモニタリングが可能です。繰り返しになりますが、動画編集の場合にはアプリケーションに加えてビデオI/Oの使用が欠かせないことは肝に銘じてください。

ユーザーデフォルトにすべきDaVinciカラーサイエンスとは?

シーン・リファードのRCMでは、ソースごとに入力カラースペース設定が必要です。それに加えて、編集やグレーディングの際に素材をまとめるためのタイムラインにもさまざまな設定プリセット(カラースペースとガンマ)が用意されています。バージョン17からは、汎用性の高いタイムライン設定として、BMD Wide Gamutが追加されました。タイムラインカラースペースは最終的な出力にも関係するため、どれにすれば良いのか悩ましい方も多いと思います。

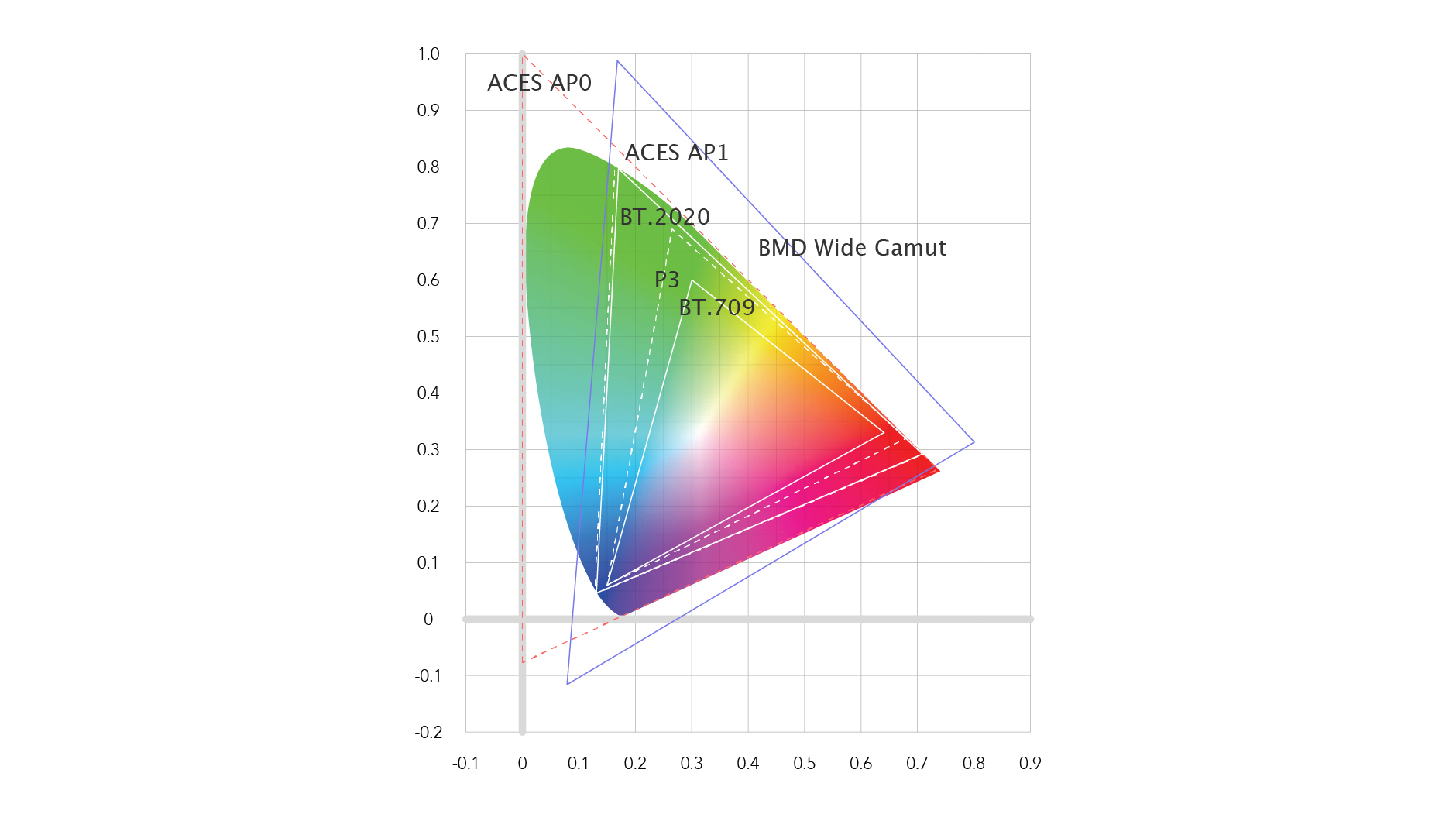

このBMD Wide Gamutは、そんなときのための現実的に使える合理的な設定と考えられます。RCMと同じシーン・リファードのカラーサイエンスであるACES(Academy Color Encoding System)では、広大な領域を定義したAP0という設定があります。この領域は非常に広く現実的にはオーバースペックになっている面もあるため、もう少し狭い領域に限定したAP1も用意されています。DaVinci Resolveでも同じような選択ができるように、現実的な領域でなおかつ広い空間のカラースペースが用意されました。それがBMD Wide Gamutなのです。2021年8月に公開されているホワイトペーパーがダウンロード(Blackmagic Design社 Webサイトへ)できるので、その中から要点を見ていきましょう。

DaVinci Wide Gamut color space (DWG)・・・カラースペース

・色域の形状を定義

・このカラースペースは、三原色と白色点のCIE色度座標で定義

DaVinci Intermediate OETF (DI)・・・ガンマ

・輝度分布を定義

・Logベースの伝達関数OETFで、18%グレー以上で9ストップを超えるレンジを持つ

まずホワイトペーパーの冒頭では、BMD Wide Gamutのカラースペースとガンマが定義されています。カラースペースは青と赤はほぼ全域をカバーしているものの、緑のあたりはBT.2020に近いエリアとなっています。現存するBT.2020やP3などの規格は全域を内包しているので、当面のプロジェクトでは十分なエリアだと言えます。ガンマ(Transfer Function)は、光から電気へのカメラ側で必要になるOETFで規定されています。Logベースのカーブで規定されていて、最大輝度(cd/m2)は、HDRのPQ規格で規定している10,000 cd/m2をカバーしています。

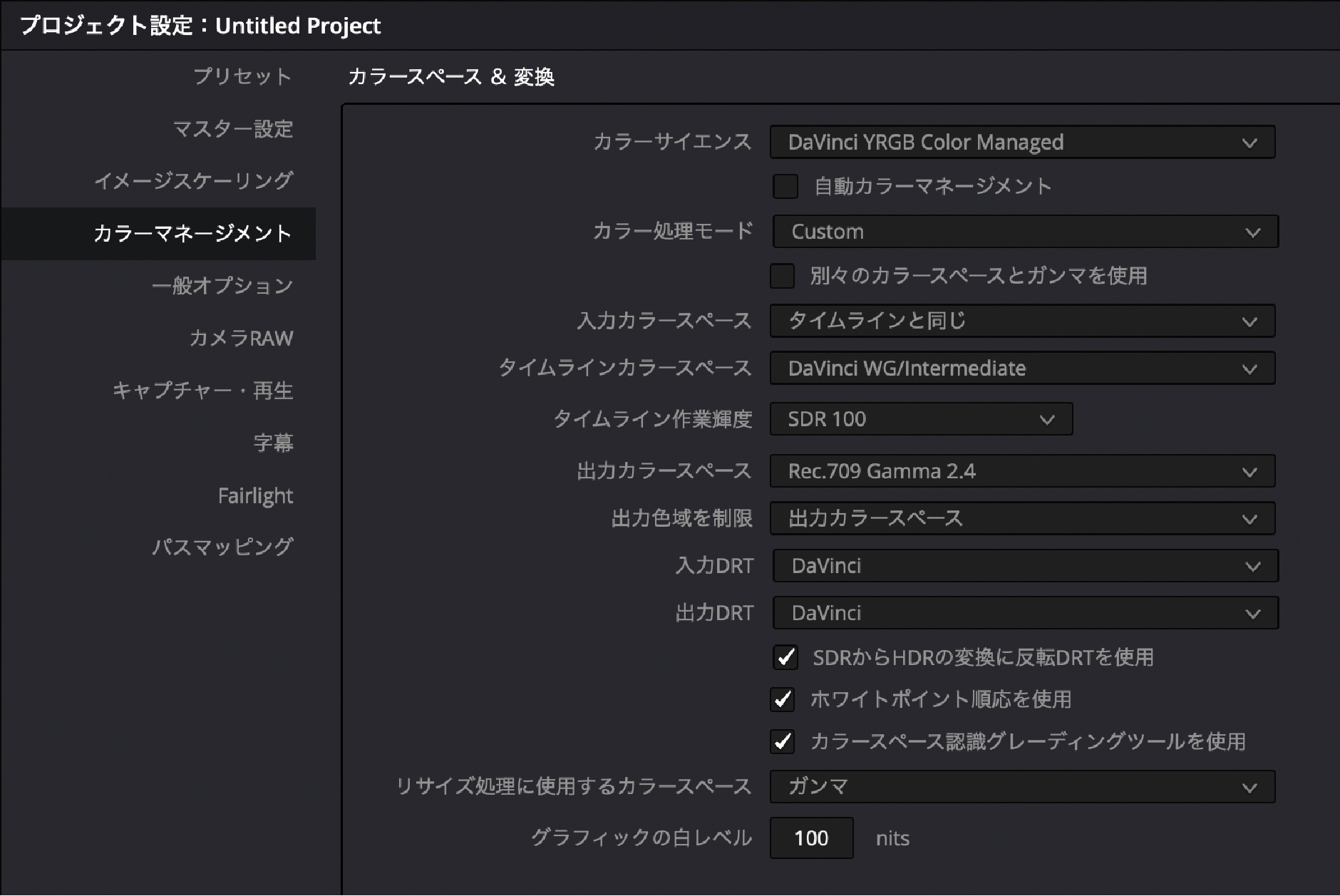

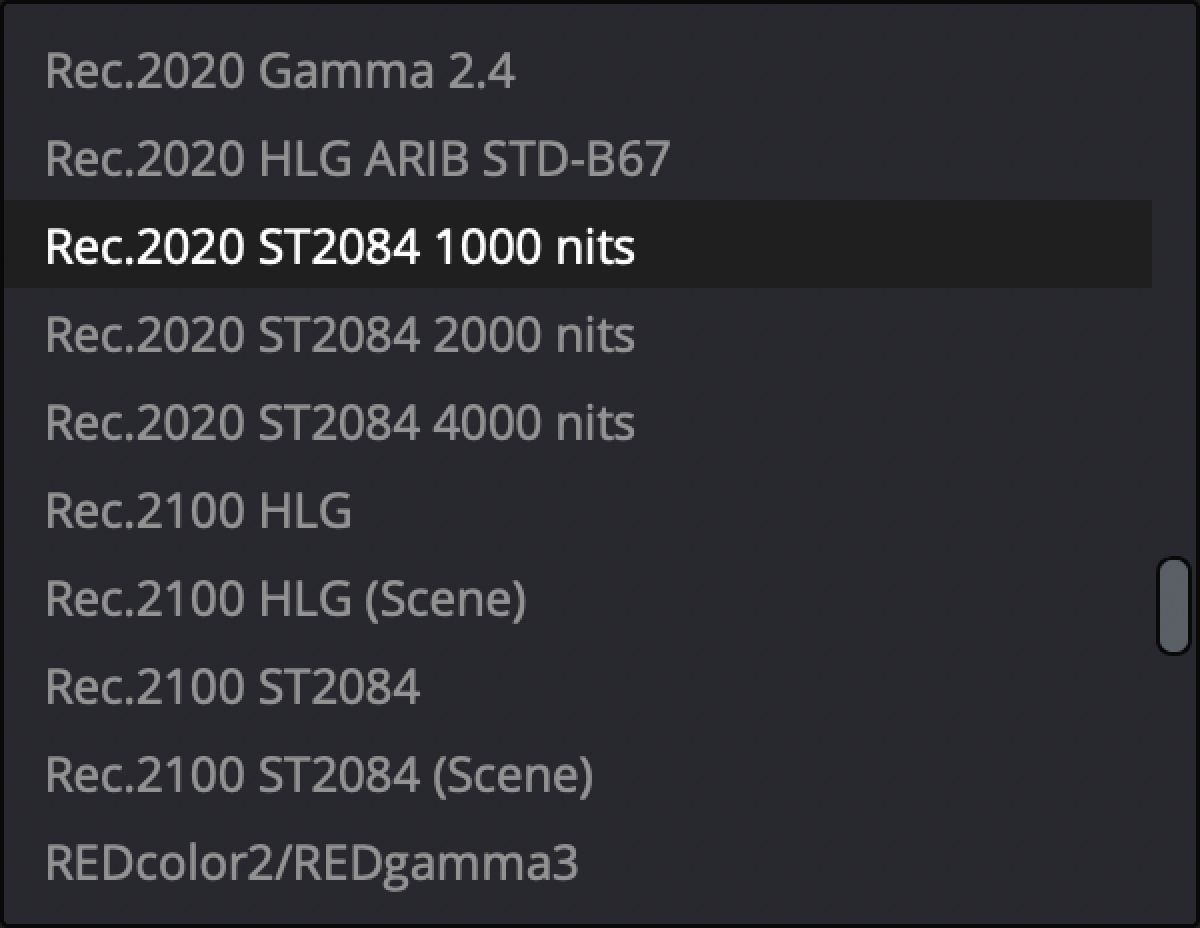

このBMD Wide Gamutが登場してからは、私のColor Management設定は上のスクリーンショットのようになりました。入力カラースペースは素材ごとに個別に設定する必要があるので、ここではあえて指定せず、「タイムラインと同じ」としています。タイムラインカラースペースは「DaVinci WG/Intermediate」に、そして出力カラースペースを用途に応じて設定しています。通常は「Rec.709 Gamma 2.4」にしています。HDR設定の場合には下記のように、この出力カラースペースのみを変更します。

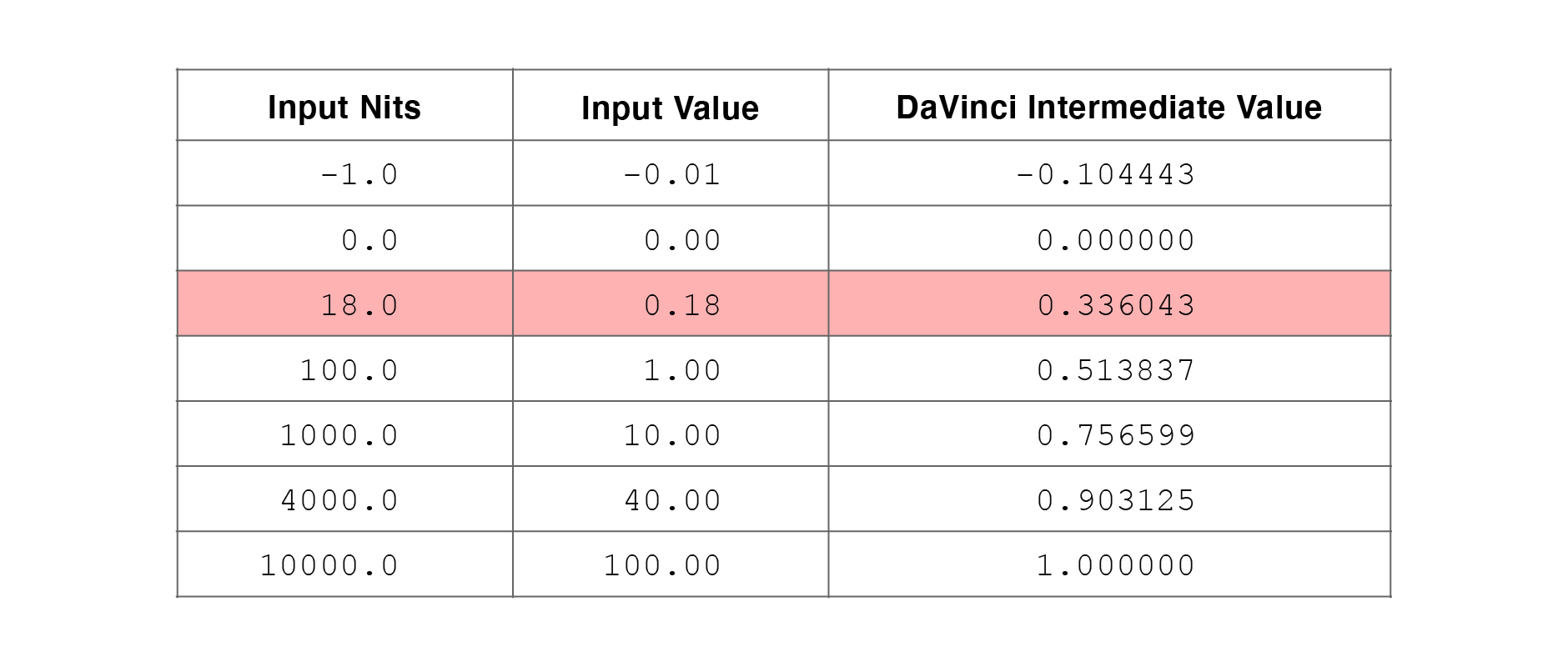

このホワイトペーパーには、18%グレーを撮影した際のコードバリューが表記されています。グレーチャートを撮影した際の絞りを、波形モニターのIREレベル33.6%にすることで、適正露出となります。簡易的な方法ではありますが、露出計を持参しておらずグレーチャートだけがある場合には、利用できる方法です。カメラでゼブラマーカーを設定できるのなら、それも併用すると設定が楽になるでしょう。

その他の色に影響を与える設定項目

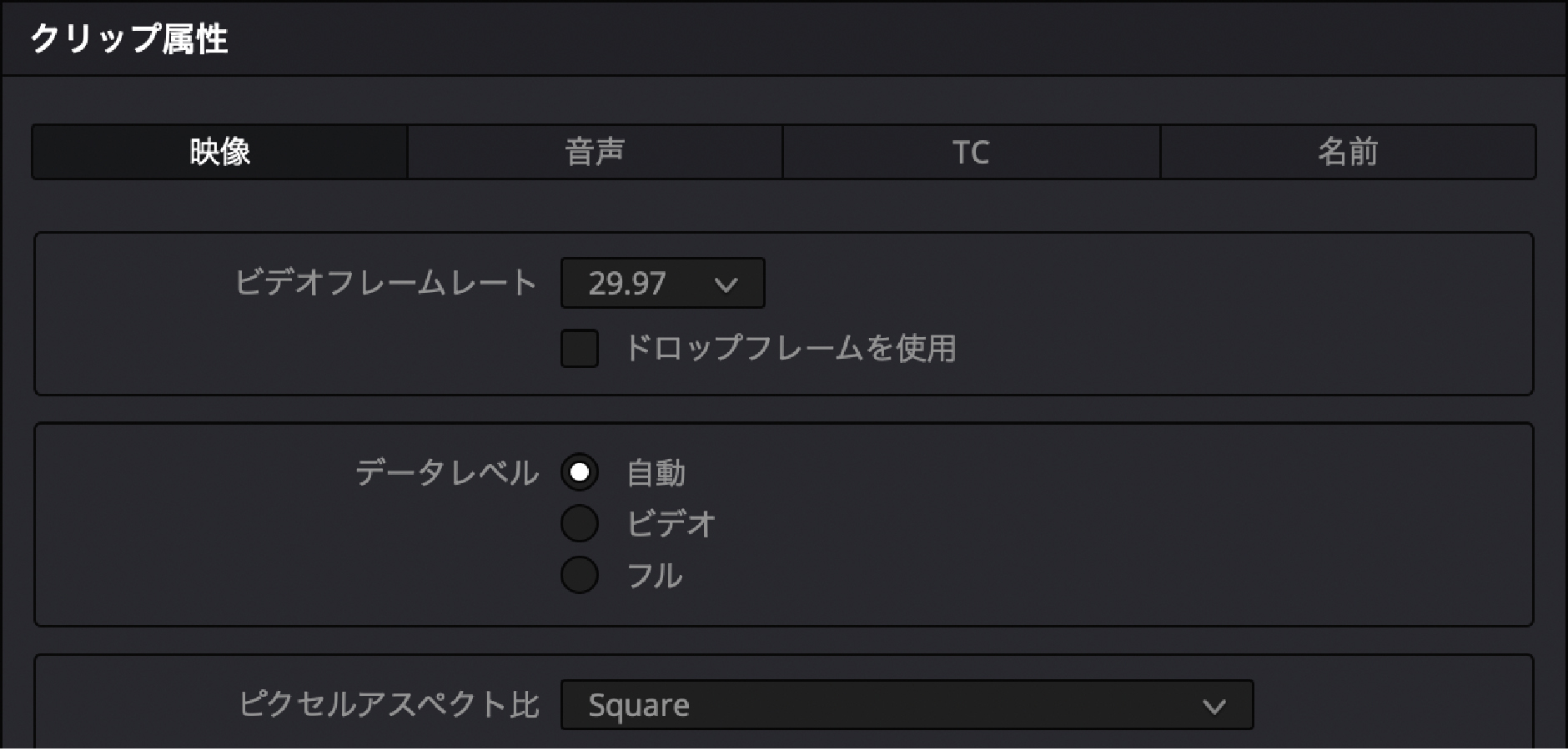

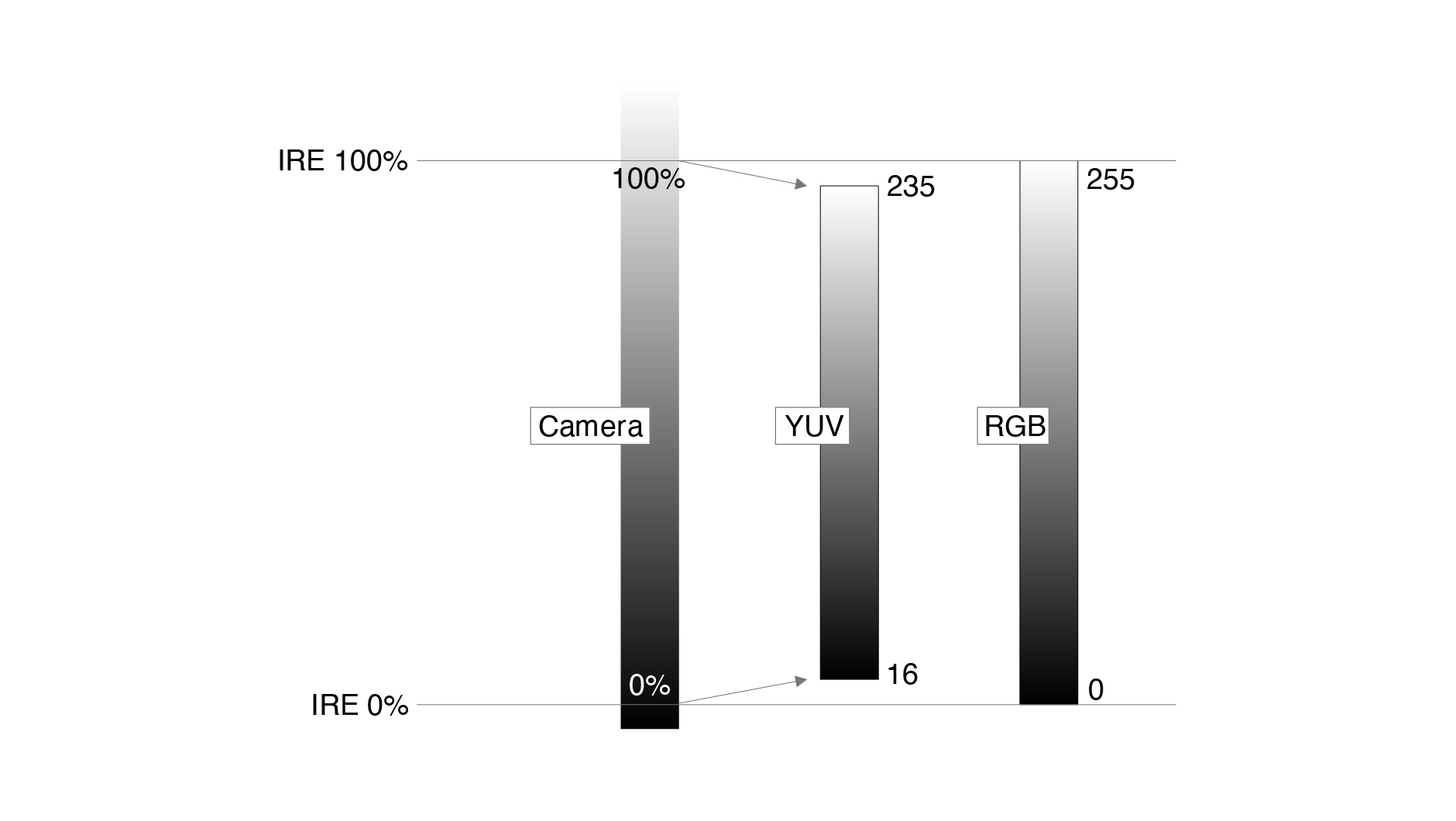

データレベル

DaVinci Resolveでは、データレベルは「ビデオ」と「フル」の二種類です。しかし、現実的な運用ではもうひとつの選択肢「自動」を使用しておけば心配はありません。第6回記事で解説したように、映像のエンコードとデコードの際には二つのレベル定義を使い分けています。フルレンジは文字通り最小値から最大値までをデータレンジ全域を使って表します。一方でビデオレンジは、アナログ映像信号の名残で、100%以上のスーパーホワイト部分の階調を記録するために設けられました。この両者のデータ形式を誤って使用すると、明るさの階調表現が欠落してしまうことがあり得ます。DaVinci Resolveではメディアファイルの入出力の際には、そのファイル内のコーデックを読み取ってRGB/YUVのデータ形式によって、フル(RGB)とビデオ(YUV)を自動的に判断しています。そのため、基本的には自動設定で心配ありません。

DaVinci Resolveでは、DaVinci Resolveに入ってくる入口、モニターやメディアファイル、SDI/HDMI回線での出力など、外側のシステムと接している部分の設定には、必ずこのデータレベルの設定が用意されています。誤って設定変更しないよう注意が必要であることと、一方で先の解説のような背景があることも併せて理解しておくことが求められます。さらに、外部モニターとの連携でも、ソース側の出力と外部モニターの入力とでこの設定が一致していることは言うまでもありません。

メタデータ

ビデオI/Oを経由してケーブルで外部にリンクする場合には影響は出ませんが、PC内で他のビューワアプリを使って映像を表示する際には重要な仕組みです。メタデータとは、メディアファイルの内部に記述されているさまざまな文字ベースの情報です。映像、音声、タイムコードなどカテゴリごとにフォーマットに直結する情報がファイル内に埋め込まれています。

Appleが以前採用していたQuickTimeでは、NCLCと呼ばれるメタデータがあり、カラースペース、ガンマ、カラーマトリクスの三つを定義していました。これを使用して、QuickTimeプレーヤーはメディアファイルの表示の色をColorSyncと連携して変更しています。メディアファイルに埋め込まれているNCLCとレンダリングされたRGB/YUVのコードバリューの特性が不一致になっていると、ビューワアプリでの発色が誤った色になってしまう危険性があるため、今後はメタデータがどのように記述されているかも、メディアファイルを作成する際の注意点です。

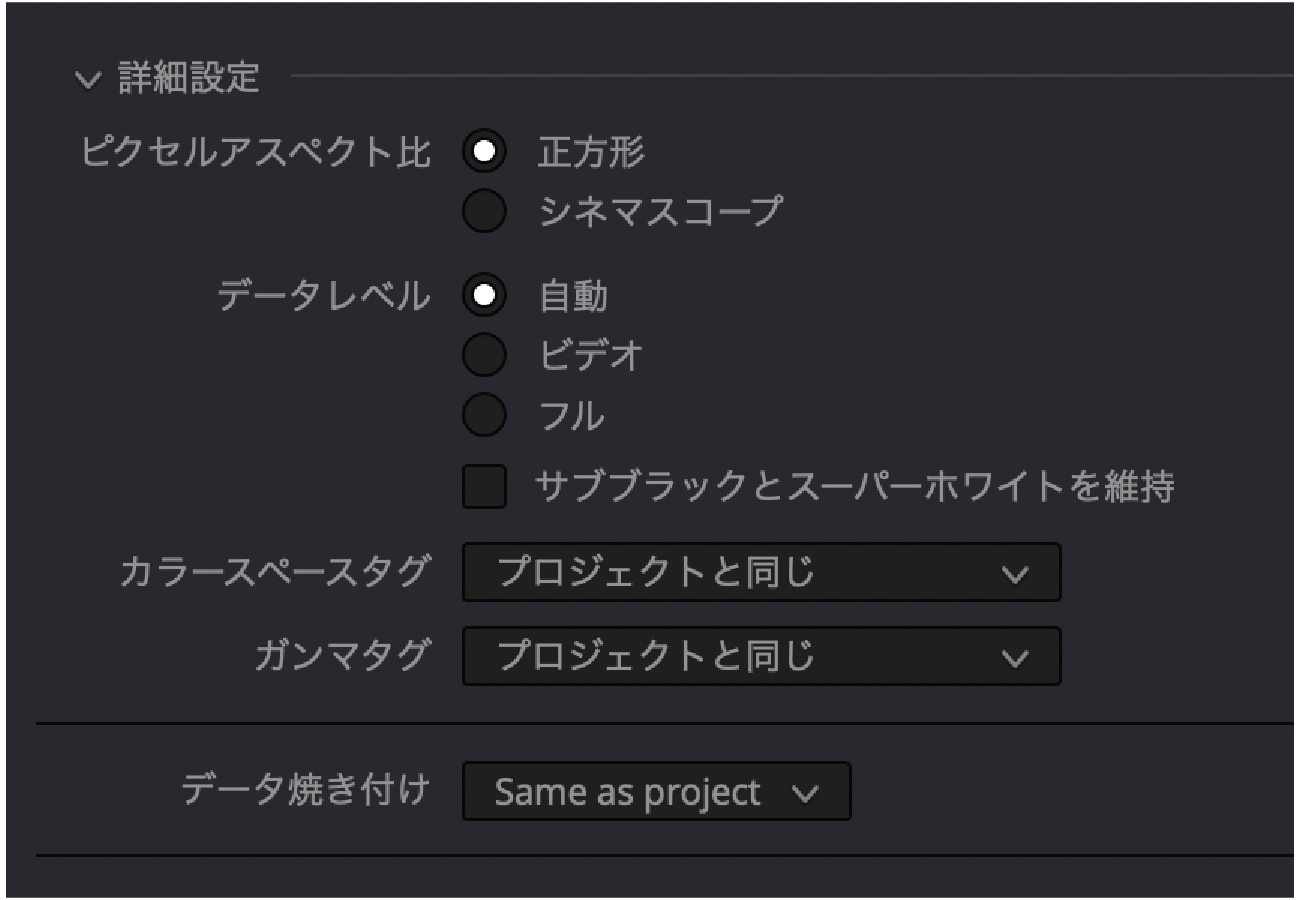

DaVinci Resolveでのメディアファイルへのメタデータ書き込み設定は、デリバーページの詳細設定の中にあります。基本はカラースペースタグとガンマタグを「プロジェクトと同じ」にしておきますが、なんらかの理由でメタデータのみに変更を加えたい場合には、ここから他の設定に切替えることが可能です。しかし、これを行うとメディアファイル内のコードバリューとメタデータが不一致になるので、十分理解したうえで操作することが必要です。

LUTを使う際の注意点

映像処理で使用するLUTは、1Dと3Dの2種類があります。1Dはトーンカーブ、3Dは立方体のキューブをイメージしてください。1DはRGB三つのトーンカーブの組み合わせで表現するので、主に明るさの調整に限定されます。これに対して3Dは色合いや色の濃さまでも詳細に変更でき、メッシュと呼ばれるLUTデータの分解能を細かくすることで精度を高め、なおかつLUTデータの肥大化を軽減できます。一般的なメッシュ数は33ですが、65もよく目にするようになってきました。

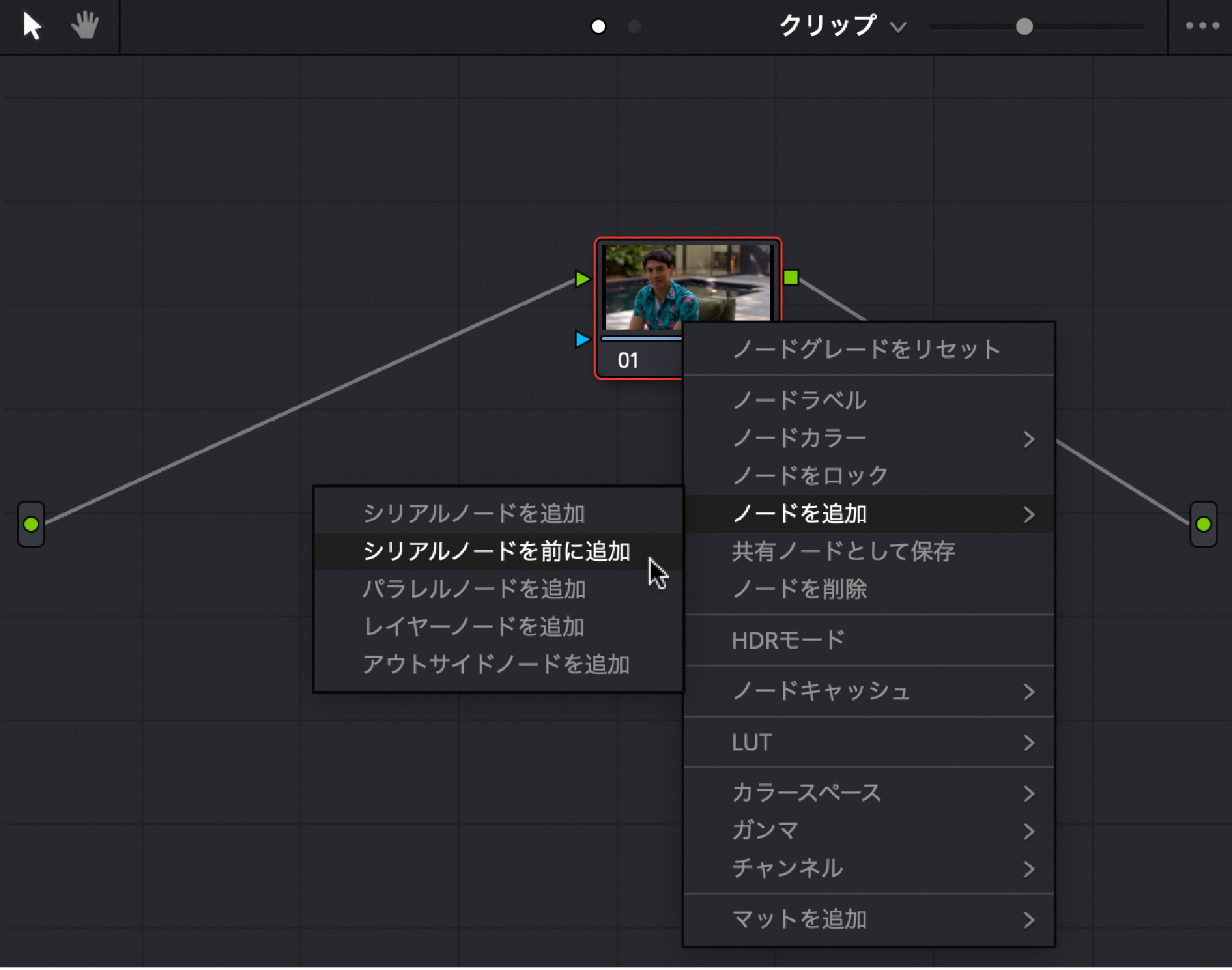

どちらのLUTを使用する際にも、LUTへの入力ファイルのハイライト部分が想定よりも高すぎる場合には、クリップして階調が欠落(ハイライトクリップ)してしまう危険性があります。この原理はDaVinci Resolveに限らずLUT処理での注意点です。Log撮影時に絞りを上げすぎた素材にLUTを適用する際には、ハイライトクリップが発生していないかの確認は欠かせません。

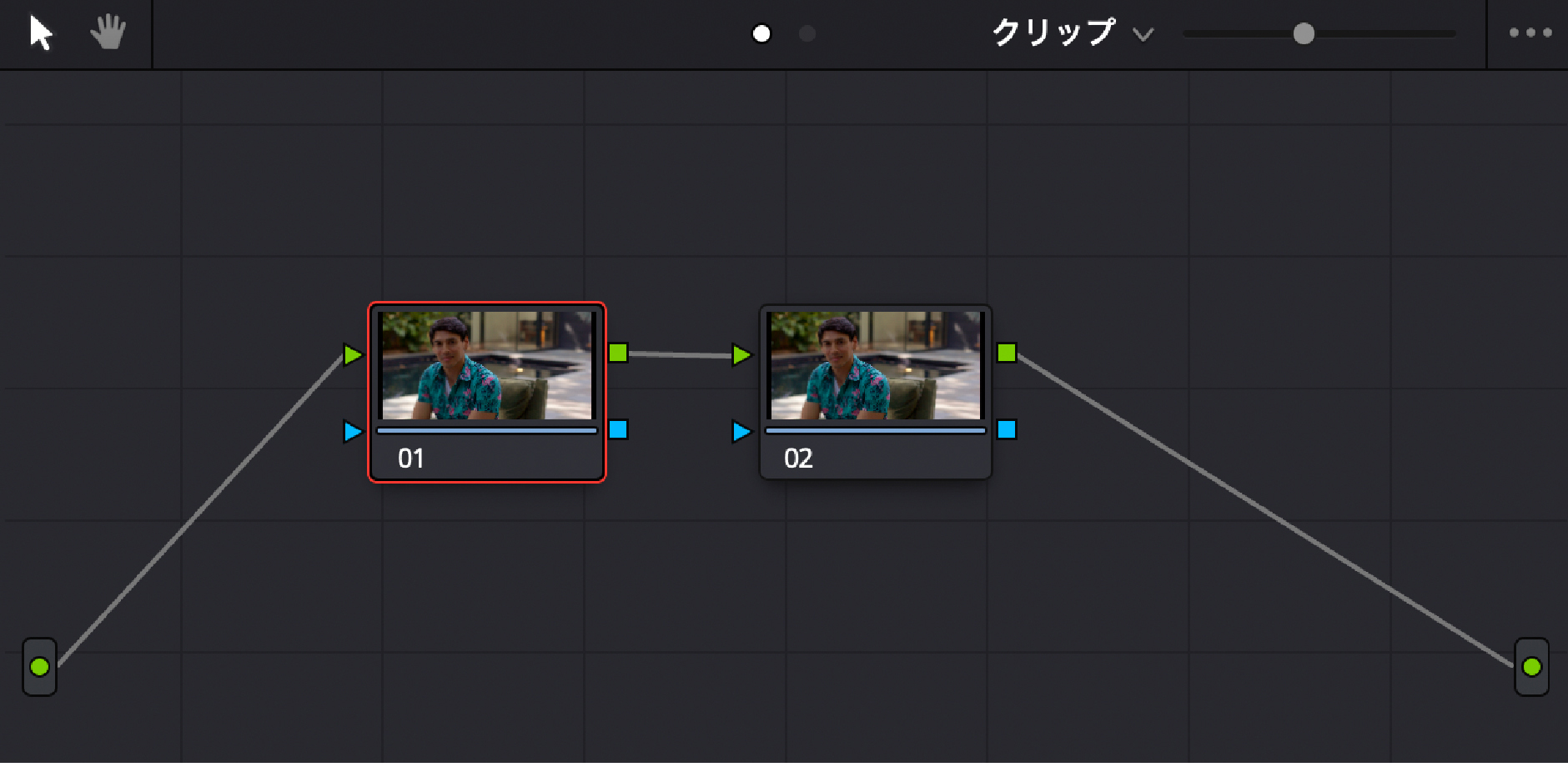

そのようなケースでは、カラーページのノード部で手前に一つ追加して、そこでOffsetを下げてからLUTを適用すると問題を回避できることがあります。上のスクリーンショットでは、ノード02の手前にノード01を追加して、オフセットからレベルを下げています。その後、ノード02にLUTを追加すると、ハイライトクリップを回避できることがあります。

DaVinci Resolveとの付き合い方

私の周りでは、動画編集はAdobe Premiere Proを使用している方が多いように見受けられます。そんな方々でも、ちょっと「真剣に」色調整をやりたいときには、DaVinci Resolveを使用するケースも少なくないようです。

編集(Premiere Pro)/色調整(DaVinci Resolve)というワークフローでは、タイムラインの移行(コンフォーム)が必要になります。そもそも異なる二つのアプリケーションでタイムラインを“変換”するわけですから、それほど簡単なことではありません。冗談のような話ですが、このコンフォーム作業のために誰かが丸々一日くらいの時間を費やしている、というようなことが日常的に行われています。ワークフローとは、時間の使い方の工夫でもあります。限られた時間をどこに注力するかは、事前に計画しておきたいものです。

カラーワークフロー連載の最新記事をいち早くお知らせするメールマガジンを発行しています。登録はこちらから

|

Webセミナーのお知らせ

|

|

筆者紹介|山本久之 |

テクニカルディレクター、日本大学藝術学部写真学科講師

テクニカルディレクター、日本大学藝術学部写真学科講師