第15回 動画モニタリングFAQ②

第14回に引き続き、多くの方が疑問に思われる内容について解説します。前回の記事と合わせて今回の記事をご覧いただくことで、映像制作でのモニタリングに関する一般的な疑問はクリアになることを目標にしています。

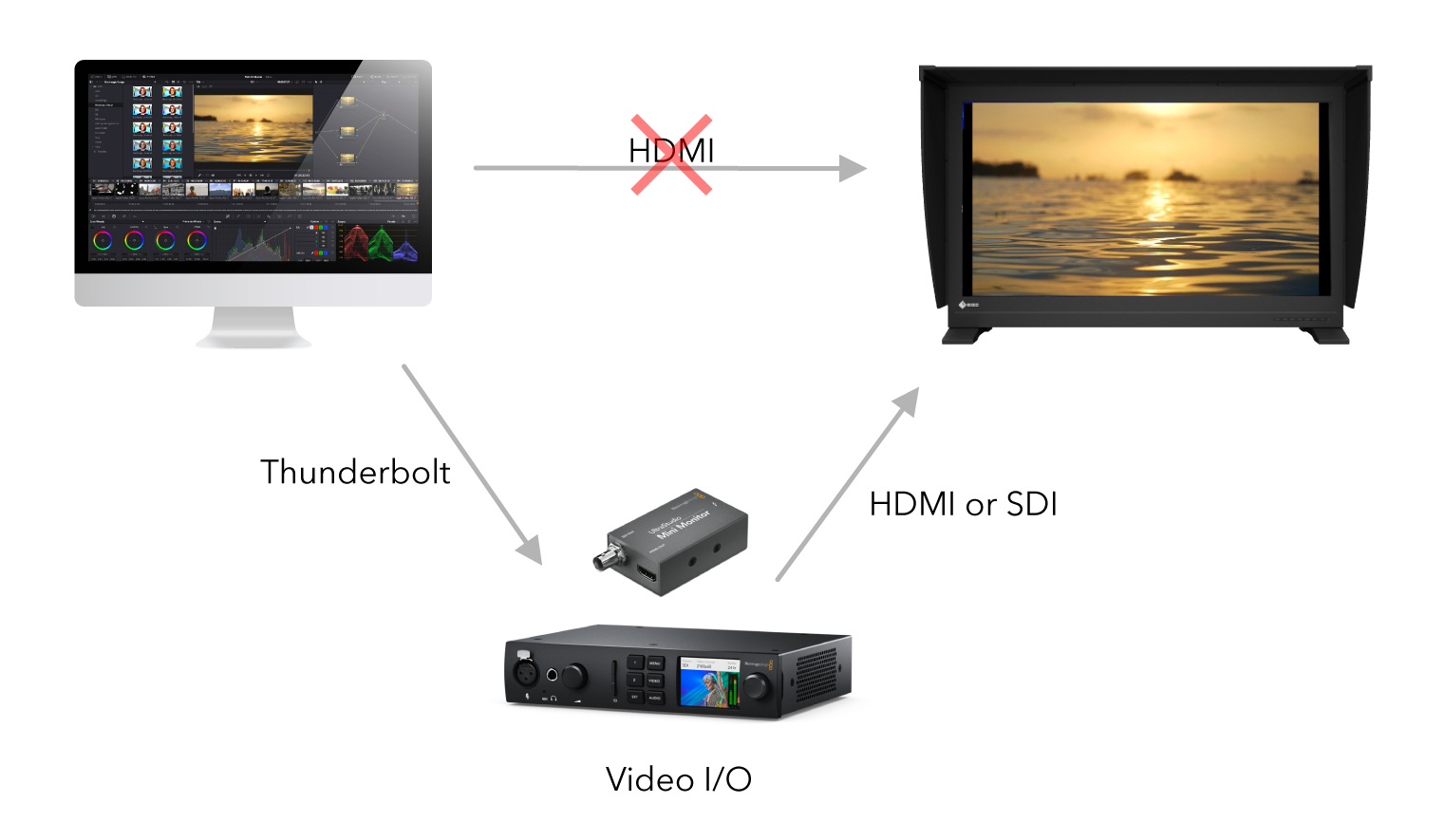

映像編集ソフトウェアを使用する際にビデオI/Oを接続する理由は?

これも何度もこの連載の中で紹介してきたテクニックです。最近のコンピュータにはHDMI出力が搭載されているモデルが多くありますが、そこからHDMIケーブルを使用してダイレクトにモニターに接続すると、映像編集ソフトウェアからビューワの映像を表示することが可能です。ですがこのHDMI接続の場合、ColorEdgeのようなリファレンスモニターを使っていても、色の再現が正しくならないという落とし穴があります。

なぜなら、コンピュータのHDMI出力から出てくる映像信号は、OSが関与しているカラーマネージメントシステムの影響下にあるからです。映像が持っているRGB値を出力する際にOSのカラーマネージメントシステムが何らかの「味付け」をしています。これによって、モニター固有の特性を加味した色調整ができるのですが、それは映像編集ソフトウェアを使用する場合には理想論になってしまいます。OSが持っているカラーマネージメントシステムでは、我々が期待するような色の精度は維持できていないのが現状なのです。将来的にはこの部分は改善されるのかもしれませんが、現状ではパーフェクトではありません。そのため、PCとモニターを直接HDMIで接続するという方法は、映像を正確な色で表示するためには、やってはいけない接続方法だということをぜひ知っておいてください。

PCとモニターを直接接続しないのであれば、どのように接続して正しい色表示を再現するのか。BT.709などのような厳格な規格に沿った信号を手に入れるためには、映像編集ソフトウェアと連動したビデオI/Oが欠かせません。DaVinci Resolveを使う際には、Blackmagic Design社製のビデオI/O製品を使う選択のみになりますが、他の映像編集ソフトウェアを使用する場合には、ビデオI/Oの選択肢も広がります。このように、ビデオI/Oを使うことで、OSのカラーマネージメントシステムが「味付け」していない信号を得ることができます。あとは、接続するリファレンスモニターが正確にキャリブレーションされていれば、正確な色の表示ができます。

Blackmagic Design社製のビデオI/OにはSDIとHDMIの二つの出力が搭載されている製品が基本ですので、接続するモニターによってどちらかを選択すれば良いでしょう。HDMIだからと言って、SDIよりも品質が下がるということはありません。ただし、双方ともにデータレベルの設定は出力のコントラストに影響が出るので、フルレンジかリミテッドレンジどちらで接続するのかは、ビデオI/Oとモニターで同じ設定にしておく必要があります。リミテッドレンジでは、さらにレンジ設定に選択肢があるので、心配な方はフルレンジで使用すると良いかと思います。私は最近はフルレンジを使用しています。ただし、システム系統の事情で途中に介在するビデオ機器がリミテッドレンジにしか対応していない場合には、この限りではありません。

| DaVinci Resolve|出力レンジ | ColorEdge|入力レンジ |

|---|---|

| フル | フル |

| ビデオ | リミテッド、またはリミテッド (109% 白) |

ColorEdgeの入力レンジ設定では、2種類のリミテッドレンジが使用可能です。「リミテッド」と「リミテッド (109% 白)」とを選択できますが、後者は輝度レンジを16〜254に拡張表示できる機能です。

映像編集ソフトウェアでビデオI/Oを必要としないケースは?

先に書いたように、映像編集ソフトウェアからリファレンスモニターに接続して運用する場合には、何らかのビデオI/Oを途中に接続する必要があります。ただし、「YouTube完パケ」のように一般的なビデオ完パケのフローとは異なるケースでは例外です。

YouTube完パケでは、最終表示媒体がスマートフォンやパソコンなどになります。Apple社製品の場合にはカラースペースはDisplay P3でシステムガンマは1.0です。これらをリファレンスモニターのキャリブレーション設定値にしても良いのですが、Mac自身のモニターで見ても良いわけです。むしろその方が最終視聴環境と等しいので安心感はあります。このように、PCの中だけで完結するようなワークフローの場合には、リファレンスモニターやビデオI/Oは使用しないという選択肢もあり得るのです。

ビデオコンテンツを制作するときに、BT.709規格を意識しているのは、不特定多数の視聴者の環境がBT.709を想定しているからです。ワークフローの計画では、最終視聴する環境からフローを上流に向かって遡っていくように組み立てるのが基本です。もしデジタルサイネージのコンテンツを制作するのであれば、理想的にはそのサイネージシステムで使用するディスプレイを用意して、そこにDaVinci Resolveからの映像を表示して確認するべきなのです。

OSのカラーマネージメントシステムがパーフェクトではない理由は?

これはMac環境で私がこれまでの経験で得た結論ですが、macOSが搭載しているカラーマネージメントシステムであるColorSyncでは、動画編集時のBT.709などの規格に対して精度を維持して出力することは現状では限界があります。その背景について解説しましょう。

ColorSyncでやっているモニター出力での仕事は、アプリケーションビューワで表示している RGB値を、接続しているモニターのICCプロファイル特性に合わせて再計算しています。Macの出力にはグラフィックのためのハードウェアがあります。出荷時に規定されている値はあるでしょうが、この値は出荷後に再測定することはありません。Macは電子機器ですから、長期間使用していると経年劣化が出てきます。さらに、モニターのICCプロファイルの精度も重要です。MacBook Proのような内蔵モニターでは、白色点の色温度が6500Kよりも高く設定されているようです。これは私が色温度メーターを使って自分のMacを確認した結果です。

このように、理論的には全ての値が理想通りに収まっていれば、正確な色再現はできるかもしれませんが、現実的にはそれほどうまくいっていないのです。そんな理由から、私はColorSyncを過信してMacとモニターを直接接続することには懐疑的です。

Macと接続したColorEdgeで映像編集ソフトウェアのGUIを表示し、ソフトウェアの操作画面や一般的なmacOSの操作をしている環境では、モニター側の状態を正確なICCプロファイルとして維持できる条件が整います。一方モニター内蔵タイプのノートPCやiMacでは、モニター部のキャリブレーションを正確に行う方法が基本的にはありません。このように、使用するモニターのキャリブレーションが正確にできるかどうかで、ベストではないもののベターな色調整は可能になる場合もあります。

一般的なHDR完パケ時のおすすめのシステム構成は?

HDR完パケの仕様によって、システム構成を計画するのが基本的な考え方です。私が経験したOTOコンテンツ制作では、納品に必要な技術的な数値が制作前に提示されていて、それに沿って撮影時のモニタリングや、カラーグレーディングの際のDaVinci ResolveやColorEdgeの設定を行いました。先に述べたように、制作フローの計画は、完成時の視聴環境から上流に遡るのが基本です。

■HDR:PQ方式、HLG方式の特長

| PQ (Perceptual Quantization) | HLG (Hybrid Log Gamma) | ||

|---|---|---|---|

| 用途 | Web配信、映画 | 放送、ライブ中継 | |

| 特長 | 人間の視覚特性に基づく新たなガンマカーブ | SDRテレビと互換性のあるガンマカーブ | |

| 輝度値の扱い |

|

相対値で扱うため、表示デバイスによって変動 | |

| 黒レベル | 0.005cd/m2以下 | 0.005cd/m2以下 | |

| 提案団体 | Dolby | BBC/NHK | |

| 関連規格 | SMPTE ST 2084、ITU-R BT.2100 | ITU-R BT.2100 | |

私が経験したOTOコンテンツは、Dolby Vision PQ準拠の規格だったので、カラーグレーディングのモニターは1,000cd/m2対応のCG3146を用意しました。もちろん接続にはBlackmagic Design社製のビデオI/OのUltraStudio 4K Miniを使用しました。OTOや放送向けの完パケではこの機材構成が基本となると思います。

ColorEdge製品には、いくつかのHDR対応の製品があります。製品によっては、最大輝度値に違いがあるので、PQ方式の場合には使用するモニターがピーク輝度を再現できるかの確認が必要です。ColorEdgeの場合は、例えば500cd/m2のピーク輝度を持つCG2700Xでは、500cd/m2までのガンマカーブはPQ方式ガンマカーブに則って表示できる機能が搭載されています。一方で、最大輝度がピーク輝度に満たない場合であれば、設定したピーク輝度のPQ方式ガンマカーブを、モニターの実際の輝度に収まるように圧縮して表示するエミュレーション表示機能も搭載されています。全体の階調バランスを確認する場合に適しています。

最近はYouTubeでもHDR完パケが難なくできるので、今後はコンテンツのHDR化が徐々に進んでいくと見ています。YouTubeの場合には、完成したファイルをSDRの時と同じようにアップロードするだけで配信できるので、広く多くの人に自分のHDR作品を見てほしい制作者には好都合でしょう。この場合にはYouTube完パケのフローになるので、リファレンスモニターは使用しなくても構わないでしょう。もし使用しているMacBook ProなどのモニターがHDR対応なら、DaVinci Resolveでの作業時にビューワでもHDR表示が可能です。DaVinci Resolveのビューワで見ているHDR感が、配信される映像とほぼ同じように確認できるはずです。

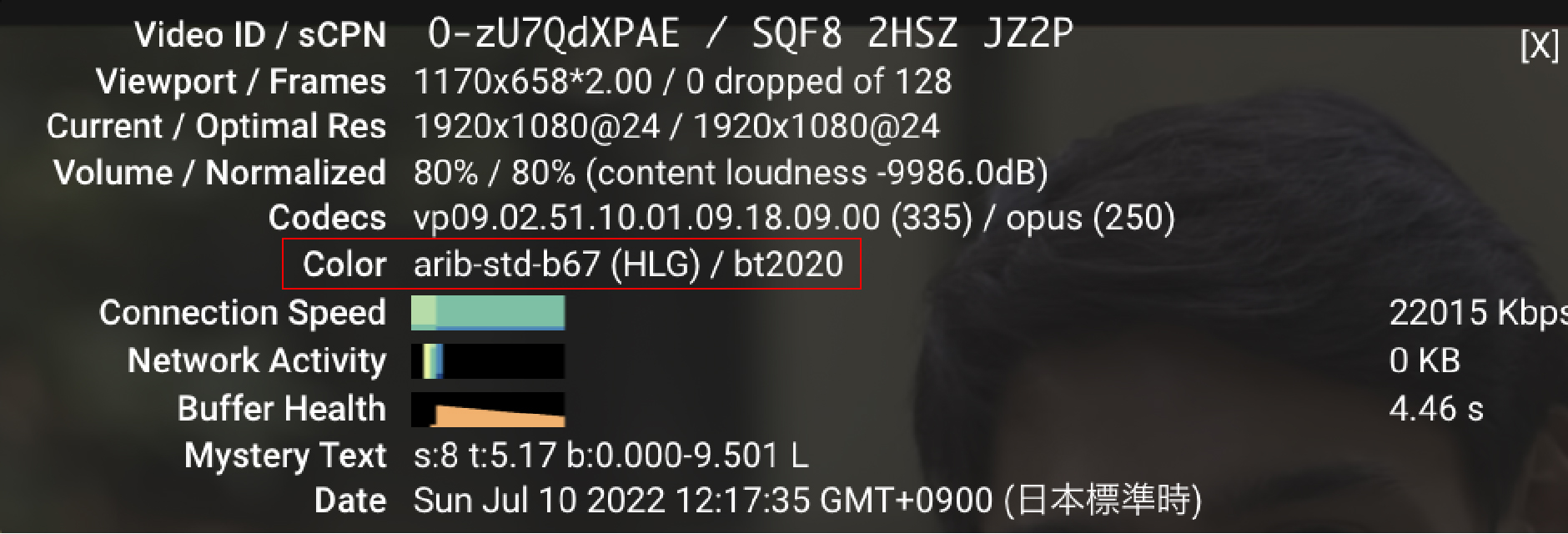

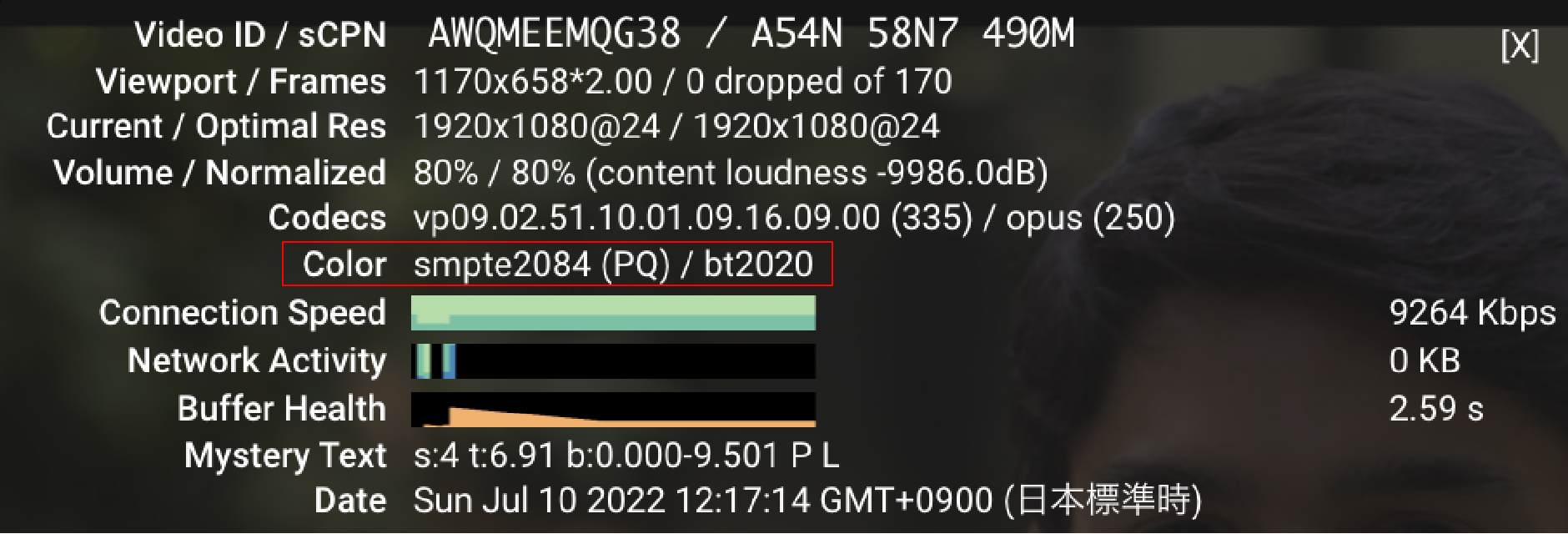

YouTubeの注意点は、アップロードするメタデータに PQやHLGのメタデータをワークフローに沿って埋め込んでおくことが欠かせない、という点です。このメタデータが埋め込まれていないと、SDR完パケとして扱われてしまいます。

■YouTubeにアップした動画のメディアファイルの仕様の確認方法

YouTubeのビューワを右クリックし、詳細統計情報を選択。「Color」の値を確認

HLG方式の場合

PQ方式の場合

HDRのガンマカーブは輝度値が厳格に規定されているPQ方式と、表示デバイスの仕様によって相対値で扱うHLG方式の2種類あります。PQ方式は、人間の視覚特性に合わせたガンマ(EOTF)で、再現性が重視される映画やWeb配信コンテンツ制作に適しています。一方、HLG方式は、従来のSDRテレビでも違和感なく表示できることを重視するため、テレビ放送やライブ中継に適しています。

HDRでは明るい輝度だけではなく、暗部の階調表現もSDRに比べると豊かになるという恩恵があります。さらにカラースペースも現実的なDisplay P3以上の色域を選択でき、これまで以上に豊かな発色で表現できるので、一度HDRコンテンツを見てしまうとSDRには戻れなくなるとはよく聞きます。

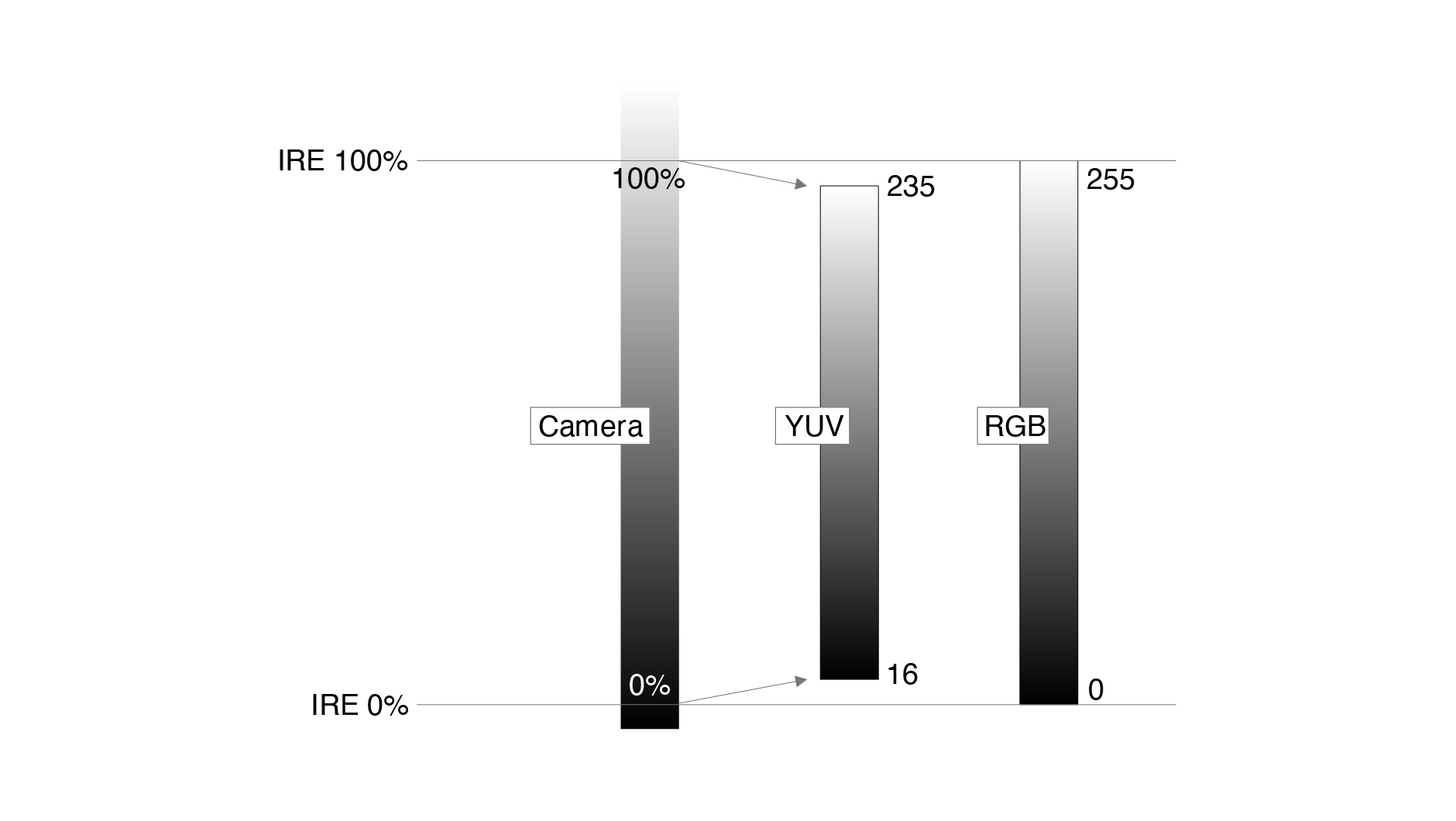

データレベルとColorEdgeのマッチング設定は?

PCの色再現はRGBの三原色が使用されてきましたが、映像はカラー放送が始まったときから現在に至るまで、一貫して色差系のYCbCr(一般的にはYUVと呼ばれることもある)が採用されてきました。RGB表現では0から100%のレンジが使われますが、色差系のYCbCrではビデオレベル0%黒よりもわずかに下のレベルと、100%よりも少しだけ明るいレベルを表現できる「余白」があります。このパーセンテージは映像信号の電圧レベルを元にして、映像の黒から白までをパーセントで表記したものです。映像信号をコンピュータに取り込んで何かの処理を加えて、再度映像信号に出力するようなフローでは、RGBとYCbCrの変換が複数回行われます。HDMIの登場により、伝送系統でもRGBが使用できるようになってきたので、RGB-YCbCr変換は少なくなっていく気配もありますが、当分はこの二つの信号の存在は知っておく必要があります。

YCbCrでは0%と100%の映像レベルが、デジタルデータになったときのコード値でRGBとは異なります。コード値255(8-bit時)がRGBでは100%でも、YCbCrでは100%ではありません。このようにRGB-YCbCr変換では、データレンジの変換が必要になります。厳密に言えば、この変換によって、RGBのレンジがYCbCrになると少しだけ階調が損なわれることになります。したがって、むやみに変換を繰り返すことは、階調を損なうことにつながると知っておくべきです。

このデータレベルは、DaVinci Resolve側だけではなく、接続先のハードウェアも同じ設定になっていることが必要です。そのため、DaVinci Resolveでは、ビデオキャプチャやモニター出力、ファイルの入出力など、外界との出入口ではデータレベルの設定ができるようになっています。モニタリングの際には、接続するリファレンスモニターとDaVinci Resolveのデータレベルの設定を揃えておくことを忘れないでください。

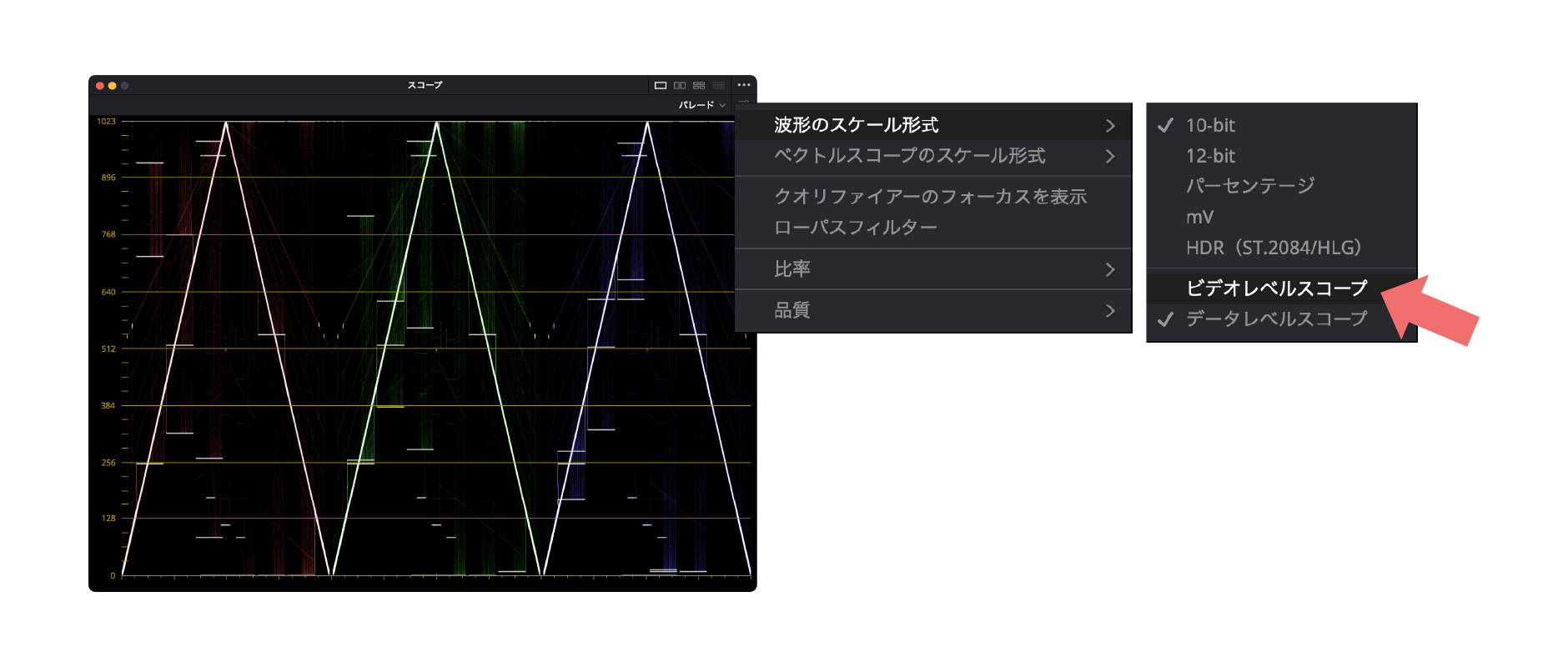

まずDaVinci Resolve側の動作を見ていきましょう。DaVinci Resolveの内部演算処理は、32-bitフローティングポイント形式でデータを維持しているので、制作時に意識している映像の0から100%のレンジの外側の情報も維持しています。0%よりも下のマイナス値や、100%以上の物理的な光のレンジに相当するような輝きをも表現できます。Colorページなどで表示できるスコープは、その時の映像のレベルをいくつかの表現で表しますが、このレベルはDaVinci Resolveの内部処理そのものを示しています。DaVinci Resolveのモニタリング時にデータレベルの違いを意識するべきなのは、ビデオI/Oから出力される映像信号が対象です。DaVinci Resolve側のデータレベルを「フル」か「ビデオ」のどちらかに切替えることで、扱っている階調をビデオ信号のレンジに置き換える処理を選択します。この設定変更を行っても、スコープ表示に変化がないため、DaVinci Resolveは何も処理変更を行っていないのだろうと勘違いしてしまいます。しかし、ビデオI/Oの制御において、データレベルの変更をきちんと行っています。どのような変更をしているかをシミュレーションする機能があるので、これによって処理をイメージできると思います。

Colorページからスコープで、オプションメニューを開いて、波形のスケール形式>ビデオレベルスコープに切替えます。すると、スコープ表示は10-bitスケールで64から940のレンジに限定されて、コントラストが低く変化することがわかります。DaVinci ResolveのビデオI/Oからの出力信号には、このような処理が加わっていると想像できます。

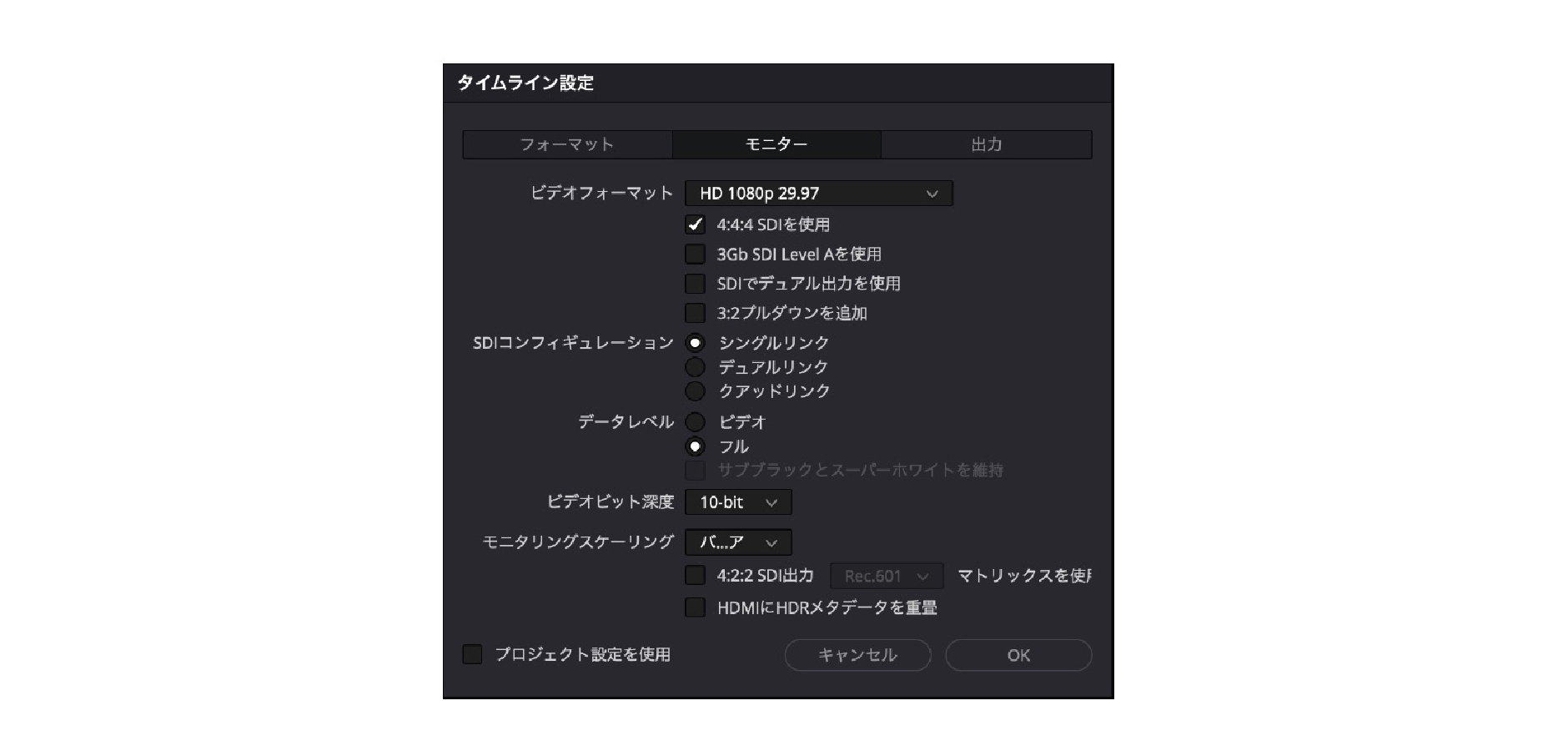

DaVinci Resolveで行うモニター出力のデータレベル変更は、タイムラインごとに可能です。そのため、設定を行うのはプロジェクト設定ではなく、タイムライン設定の中にあります。プロジェクト設定の中にも同様の設定がありますが、そこで設定変更しても反映されないので注意が必要です。CutかEditページからタイムラインのサムネイルを見つけ、右クリックからタイムライン設定に進みます。3つのタブがありますので、2つ目の「モニター」に切替えます。その中にあるデータレベルの項目が設定箇所になります。繰返しになりますが、ここでの変更を加えてもDaVinci Resolve内のビューワやスコープに変化は起こりません。「ビデオ」か「フル」どちらを選択するのかは、接続先のリファレンスモニターの設定に従います。

私がおすすめする設定は、「フル」を使用することです。「ビデオ」を使用すると厳密には階調が少しだけ間引かれてしまうので、理想的には「フル」を使用したいと考えています。「ビデオ」設定が今でも残っている背景には、VTRとの入出力では「ビデオ」が使用されていたからで、その名残であると言えます。すでにVTRとのやりとりは過去のものになっている現状からは、この先のモニタリングでは「フル」を使うことが合理的であると考えられます。しかし、現実的にはシステム構成によっては「フル」が使用できないケースもあります。例えばBlackmagic Design社のHDMI信号のスイッチャーATEM miniシリーズの出力は、YCbCrに限定されているようです。このようなケースでは「フル」ではコントラストが正確でなくなるので、「ビデオ」を使用することになります。

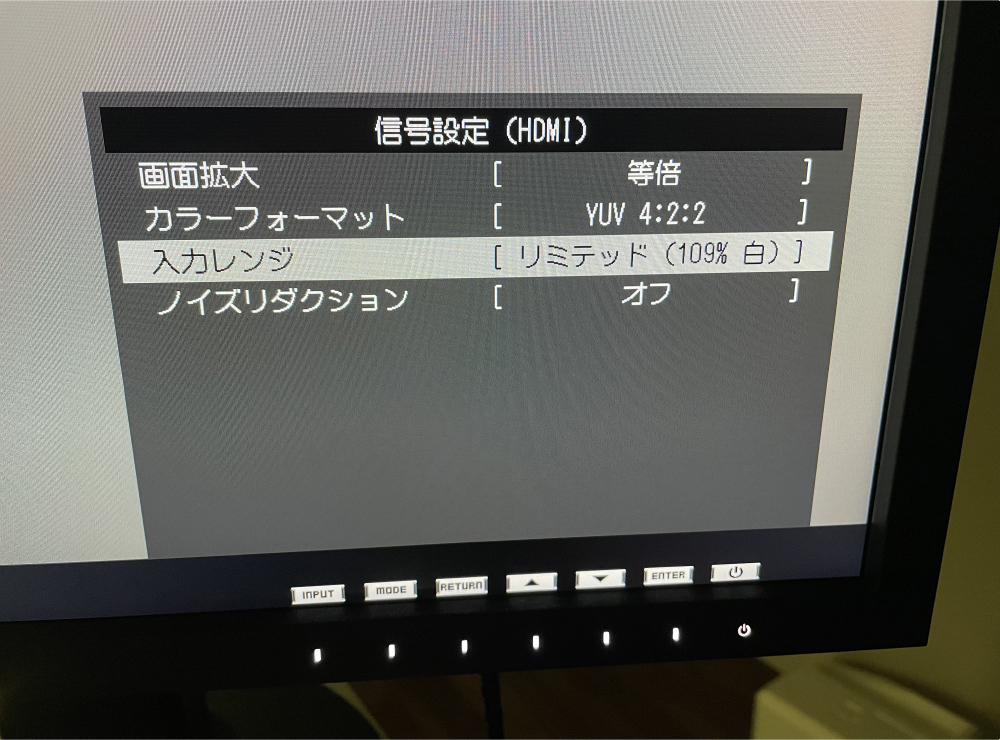

次に、ColorEdgeを使用したときのデータレベルの取扱いを見ていきましょう。ColorEdgeシリーズでは、データレベルのことをマニュアルでは入力レンジと表記しています。ColorEdgeモニター本体前面のスイッチから「メニュー」を開き「信号設定」に進みます。その中にある入力レンジで設定しますが、ビデオレンジへの設定項目は二つ用意されています。「リミテッド」と「リミテッド (109% 白)」です。これ以外に「自動」と「フル」がありますが、前者は信号を自動判別して「リミテッド」か「リミテッド (109% 白)」を使用します。「フル」はレンジ拡張処理を行いません。

リミテッド

入力信号の輝度レンジを16〜235(10ビット:64〜940)から0〜255(10ビット:0〜1023)に拡張して表示します。

リミテッド(109% 白)

入力信号の輝度レンジを16〜254(10ビット:64〜1019)から0〜255(10ビット:0〜1023)に拡張して表示します。

CS2410の場合、このようにマニュアルでは表記されています。どちらが正解ということではなく、入力信号のレンジをモニターの表示レンジに合わせるための選択と考えてください。「リミテッド (109% 白)」は、コード値235以上のスーパーホワイトも階調を維持して表示できる代わりに、ビデオレベル100%のコード値235が、RGBの100%に比べて少し暗く表示します。「リミテッド」は、ビデオ信号の0〜100%(コード値16〜235)に限定して表示します。これにより、「リミテッド (109% 白)」よりも多少明るく表示されます。

CS2410の信号設定画面

モニターの応答速度は速くなければならないか?

私の個人的な見解になってしまいますが、液晶タイプのモニターでは過去に多用されていたブラウン管タイプのモニターに比べると、表示方法の違いによって速い動きの映像の表現に課題があります。

仮に制作用のモニターに応答速度の速いモニターを使用していたとしても、最終的に一般視聴者が見る環境では応答速度が速いモニターに限定することは不可能です。現状では液晶タイプの表示デバイスがスタンダードになっている現状から、動きの速いコンテンツでは再現性に不十分な点がある前提で制作を進めるのが現実的だと考えています。したがって、編集時に必ずしも応答速度の速いモニターが必要かと問われると、私はそこまで神経質になる必要はないと答えています。

カラーワークフロー連載の最新記事をいち早くお知らせするメールマガジンを発行しています。登録はこちらから

|

筆者紹介|山本久之 |

テクニカルディレクター、日本大学藝術学部写真学科講師

テクニカルディレクター、日本大学藝術学部写真学科講師