第12回 HDR映像(3)制作現場で必要な現実的なHDR技術

HDR集中解説企画第3弾の今回は、これまで触れてこなかった部分を中心に、現実的な映像制作でHDR技術を利用する際の注意点について解説していきます。これまでの連載では、HDR技術をガンマを糸口に解説してきました。HDR技術はまだ登場してからそれほど時間も経過していないので、私を含め経験値を多くは蓄積できていないという状況にあります。そんな中で理解をスムーズに深めるために、HDRの中心にあるキーワードであるガンマについて深く掘り下げてきました。

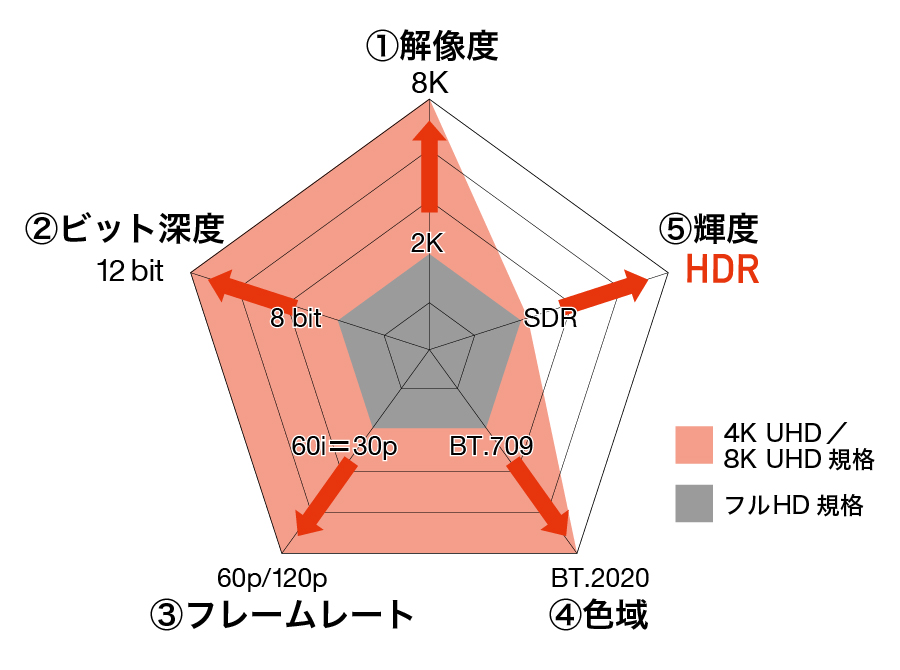

以下のチャートにあるように映像の画質を左右する要素は5つあります。HDRにはそのすべての要素が必須要件だと思われ、HDR映像の解像度は4Kが必須であるとか、HDRでは色域はBT.2020でなければならないなど、誤解を招いている面もあるようです。それを払拭するために、国際的な規格ではどのように定義されているかを見てみましょう。

|

高画質をかなえる5つの要素

|

BT.2100-2 規格書

|

規格から見るHDRフォーマット

ITU-R(国際電気通信連合無線通信部門)が2018年7月に勧告したBT.2100-2には「制作や国際的な番組交換に使用するハイダイナミックレンジテレビの画像パラメータ値」というサブタイトルが付いており、細かくフォーマットの仕様が記述されています(規格書はこちら)。この規格書の冒頭に書かれているのですが、アスペクト比は16:9のみを規定していて、放送を中心としたコンテンツへの利用が伺えます。そして、解像度は、4K以外では7680×4320(8K)と1920×1080(フルHD)も規定されています。「HDRコンテンツの解像度は4Kなんでしょ?」と言っているのを何度か私は耳にしたことがありますが、解像度に関しては4Kの縛りはなく、さらにフレーム周波数も60Hzだけではなく、24、25、30、50、100、120など、多岐に渡っています。画像フォーマット(スキャン方式)に関しては、さすがにインターレースは除外されておりプログレッシブのみとなっています。

画像の空間的・時間的特性(ITU-R BT.2100-2より)

この規格は、HDRフォーマットとしてガンマにはPQとHLGが明記されており、ガンマに対する数式が細かく規定されています。しかし、カラースペースに関しては、冒頭でさらりと書かれているだけなのが印象的でした。CIE1931の色空間における、RGBの3つのカラープライマリー座標と、白色点座標が定義されています。明確にBT.2020とは表記されていませんが、座標値を見るとBT.2020のそれであることが確認できます。

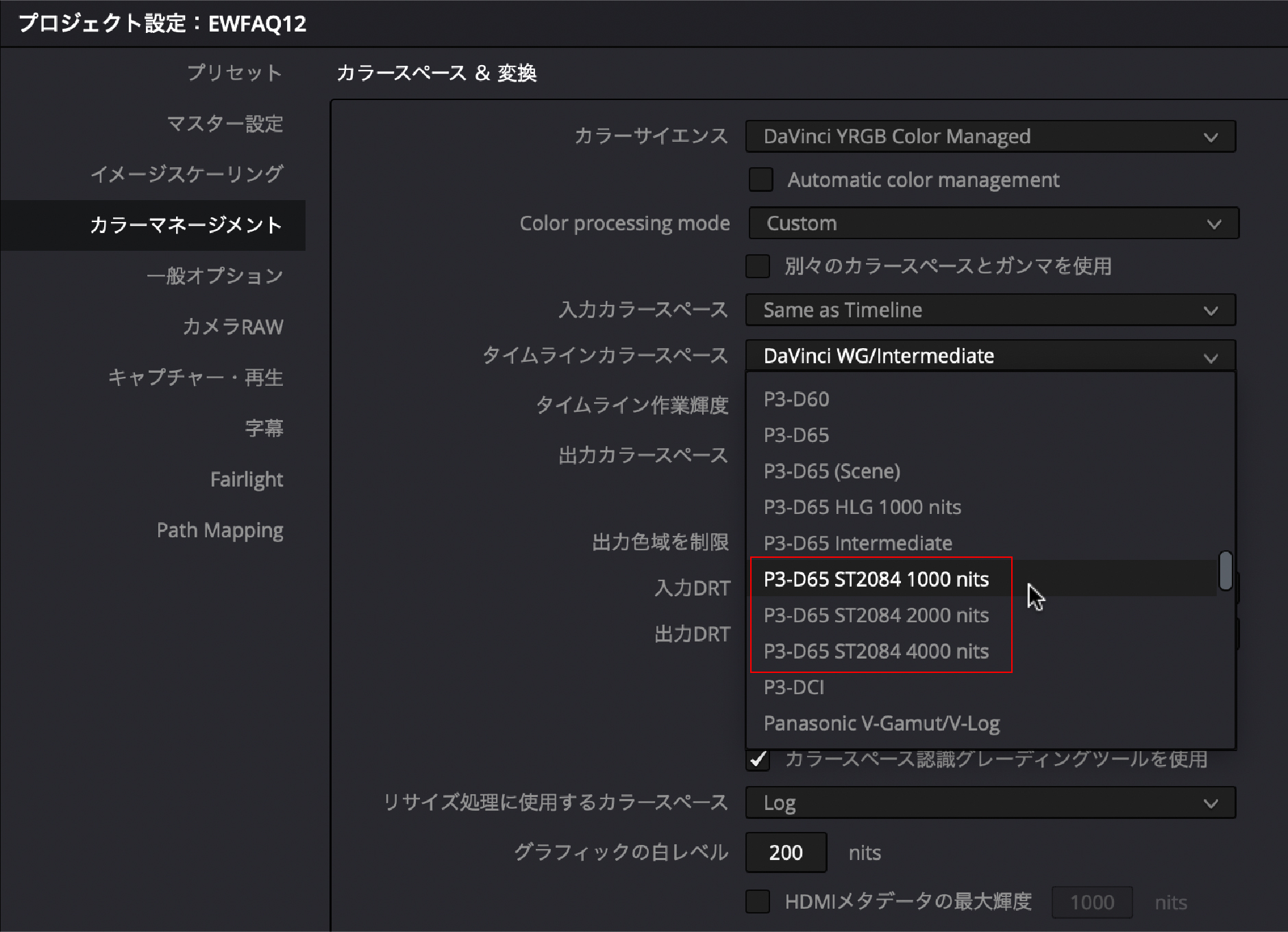

当連載では、これまで2回に渡ってガンマを中心にHDRを解説してきました。HDRを理解するためには、ガンマについての知識を深めることが大切なのです。そして、HDRコンテンツを制作する際には、完パケ(完成)時の解像度とカラースペースは独立して考慮すべきです。HDRは4K解像度でなければならないというのが誤解であることを理解いただけると幸いです。このように、いわゆるガンマであるTF(Transfer Function)とカラースペースや解像度を個別に考えていくと、実は完パケ時のフォーマットパターンが非常に多く増えてしまうことがわかります。カラースペースは規格書の座標値からBT.2020と読み取れますが、すでに運用面ではこの広大過ぎるカラースペースが現実的ではないとの考えからなのか、DCI-P3色域で完パケをする動きも出ています。DaVinci Resolveでも、それに合わせたプリセットがすでに用意されています。私の周りで聞いた事例では、BT.709色域でHDR完パケを行ったというものもありました。

DaVinci Resolve カラーマネージメント設定画面

現状で想定できるHDRフォーマットの組み合わせ

| HDR方式 |

・PQ ・HLG |

|---|---|

| 解像度 |

・8K(7680×4320) ・4K(3840×2160) ・HD(1920×1080) |

| カラースペース |

・BT.2020 ・DCI-P3/Display P3 ・BT.709 |

ビデオI/OとHDRフォーマット

映像をOSのカラーマネージメントの影響下に置かれずに正確にモニタリングするためには、ビデオI/Oが欠かせないことは、これまで繰り返し述べてきました。その考え方はHDRコンテンツ制作でも同様です。私はDaVinci Resolveを多用するので、Blackmagic Design社のUltraStudioシリーズをいつも使っています。このようなビデオI/Oでは、HDR出力をどのように扱っているのかを考えてみましょう。

一般的なビデオ信号であるBT.709を扱うときには、データレベルの最小値から最大値までをコード化して、HDMIやSDIを経由してモニターに送ります。アプリケーションにもよりますが、DaVinci Resolveでは出力カラースペースの設定により、BT.709(BT.1886)に適合したガンマ補正(EOTF)が加えられ出力されています。HDRでも基本的には、これと同様の処理が加えられていると考えられます。HDRだからと言って、特別なデータ形式ではありません。伝送されるデータレベル自体にはSDRかHDRを特定する情報はなく、伝送される信号のメタデータにその情報が付加されます。

モニター側では、送られてきたコード値によって光を制御しています。どのような光に変換するのかは、キャリブレーション時の設定値とユーザーによる多少の調整変更に依存します。例えば、コード値(10-bit)で940のデータがモニターにやってきたら、SDRでは100cd/m2で光りますが、HDRでは規格上は1000cd/m2以上の輝度が出るITU-R BT.2100準拠のリファレンスモニターであれば1000cd/m2以上で光るはずです。このように、10-bitや12-bitの出力コード値自体には、SDRもHDRも区別がないわけです。

Blackmagic Design社のビデオI/Oは用途に合わせてラインナップされていますが、最も安価なUltraStudio Monitor 3Gでも実はHDRをサポートしています。恥ずかしながら、このことを知ったのは最近のこの連載に連動したWebセミナーでコメントをいただいたからでした。私の記憶では以前は未対応だったのが、いつからかHDRをサポートしているという機能向上が図られていました。

HDRフォーマットは、ガンマ特性を示すTransfer Function(OETFやEOTF、OOTF)と、カラースペースなどにより定義されます。フルHD解像度しかサポートしていないUltraStudio Monitor 3GでもHDRをサポートしていることは、HDRフォーマットの理解を深める上でのヒントになるのではないでしょうか。つまり、HDRフォーマットは4K解像度という縛りがない、ということです。ちなみに、UltraStudio Monitor 3Gでは、HDMI出力とSDI出力にHDRのメタデータを載せる機能が搭載されています。これにより、HDR表示に対応したテレビのようにHDR設定が詳細にできない表示デバイスに出力した場合にも、メタデータからHDRのスペックを読み取ることができるでしょう。

先日、UltraStudio Monitor 3Gとその上位モデルのUltraStudio 4K Extreme 3を使って、HDRコンテンツの表示をColorEdge CG2700Sで確認する機会がありました。当然ではありましたが、その発色に関して違いはありませんでした。フルHDコンテンツの制作であれば、リーズナブルな価格のUltraStudio Monitor 3GでもHDRでのモニタリングができることを知っておくと役に立つと思います。

HDRコンテンツ制作の流れ〜撮影

実はHDRコンテンツの撮影は、すでにRAWやLogを経験していればそれほどハードルが高いわけではないと私は考えています。なぜなら、PQ方式を想定している場合には、撮影時の工程はRAW/Logと同じと考えられるからです。ただし、Log記録のカメラ機材を使用する場合には、カメラの内蔵記録による高圧縮や8-bit収録は避けるべきです。後処理での「粘り強さ」があるLogとはいえ、10-bitのProResなどのイントラフレーム収録は外せないとするべきでしょう。さらに、PQ方式での完パケを前提としていますが、撮影時にもPQガンマに対応したリファレンスモニターを用意してモニタリングすべきかという点は、撮影現場での機材が複雑になる現状を鑑みれば、当面は従来のSDR対応モニターでのモニタリングが妥当ではないかと私は考えています。ただし、いつもよりはハイライト側のクリップには気を使った、露出設定が必要にはなります。

HLG方式での撮影で、完パケもHLGという流れは、放送用途での限定的なフローではないかと思います。この場合には、HLG最大の特徴である、撮影時にHLG対応モニターを使えば対応機器とダイレクトにケーブルで接続するだけで、HDR感を正確に再現できるという利点は活かすべきでしょう。PQ方式でもDaVinci ResolveとビデオI/Oの組み合わせなどを使用することで、PQに適合した信号で確認できますが、DaVinci Resolveでの設定が必要なので、ケーブル接続のみでモニタリングできるHLG方式ほど簡単ではありません。

HDRコンテンツ制作の流れ〜ポスプロへの準備

HDRコンテンツを撮影できた後には、ポスプロ工程への準備に入ります。ここでの選択肢としては、オフライン編集に向けたプロキシファイル(代理ファイル)をどのように作成するかです。もっともシンプルに進めるためには、従来のようなSDRのプロキシファイルを使用することを検討すると良いでしょう。これならば、HDR完パケではあるものの、オフライン編集時点ではこれまでと同じ感覚で進められるからです。DaVinci Resolveバージョン18からは、プロキシファイルを作成するアプリBlackmagic Proxy Generatorを、独立して使用できるようになっています。これにより、DaVinci Resolveの作業と並行して、プロキシファイルの作成が可能になります。

プロキシ・ジェネレーター( Blackmagic Proxy Generator )

オフライン編集の工程として、HDRモニターを使った編集という新しい工程も、この先徐々にではありますが増えてくると考えておくべきです。4K解像度での大きなサイズで撮影するときのプロキシファイルを使ったオフライン編集の経験値がやっと上がってきたところに、さらにまた新しいやり方が進入してくるのか、と憂鬱になる方もいらっしゃるかもしれませんね。オフライン編集時に、色合いの確認も一定のクオリティでやりたいということは、特にディレクターからは切望されるのではないかと思います。4K解像度での撮影では、低い解像度で撮影するよりもカットの時間が長めになる傾向がありました。4K解像度で撮影された映像はじっくりと見たくなるため、カットの長さが増える傾向にあったのです。HDRコンテンツでもこの現象があり得ることは、知っておくとよいと思います。

HDRコンテンツ制作の流れ〜カラーグレーディング

HDR完パケに向けたカラーグレーディング作業は、現実的なシステムとしてはDaVinci Resolveを中心にした構成に落ち着くと言えるでしょう。素材ごとのきめ細かなプロファイルの選択、各種HDRフォーマットに対応したプリセットの数々、そしてモニタリングと出力メディアへの正確なレンダリングなど、他のアプリケーションではカバーできない点を兼ね備えています。DaVinci Resolveを使ったシステムでは、必ずHDR対応のビデオI/Oをセットで使用して、ColorEdgeなどのHDR対応モニターで表示確認することになります。ビデオI/Oを使わない簡易的なモニタリングは、HDR完パケでは成立しないのでこの点は肝に銘じてください。

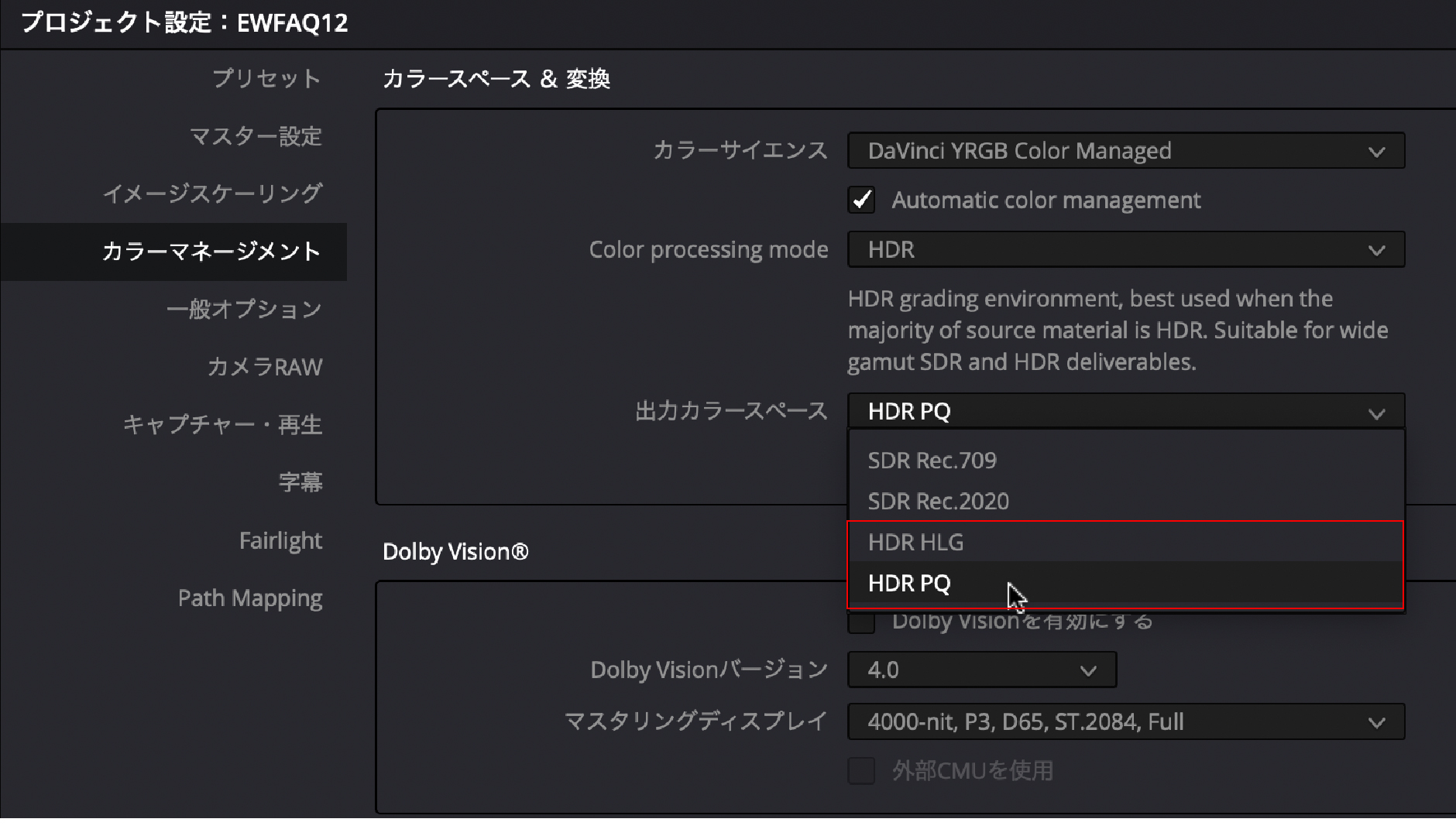

DaVinci Resolveのプロジェクトを新規作成したら、何をおいてもカラーマネージメント設定を確認してください。HDRコンテンツの制作経験が少ない場合には、プリセットを使用すると安心です。これにより、タイムラインカラースペースと出力レンダリングの設定はDaVinci Resolveがやってくれます。この場合、ユーザーは素材ごとの入力カラースペースのプロファイルを選択するだけでよいです。

DaVinci Resolve カラーマネージメント設定画面

HDRコンテンツ制作の際は、DaVinci Resolveのカラーマネージメント設定の「カラーサイエンス」は、デフォルトのDaVinci YRGBではなく、DaVinci YRGB Color Managedを必ず使用する必要があります。なぜなら、デフォルトのDaVinci YRGBはHDRには対応していないからです。

| DaVinci YRGB | DaVinci YRGB Color Managed |

|---|---|

| HDR非対応 | HDR対応 |

ColorEdge側では、事前にHDR表示に対応したプリセットのカラーモードでキャリブレーションを済ませておくことをおすすめします。ColorEdgeではカラースペースとガンマの設定に加えて、入力レンジの設定がDaVinci Resolveのビデオ出力の設定と同じになっていることを確認してください。これが一致していないと、せっかくの階調を正確に表示できないままの完パケになってしまいます。私はなるべく、フルレンジを使用するようにしています。

HDRコンテンツ制作の流れ〜メディアファイルの出力

DaVinci Resolveでのカラーグレーディングが完了すれば、そのままでレンダリングを実行するだけです。書き出したメディアファイルの形式が、MOVであればメタデータとしてHDRの情報などが書き込まれます。このメタデータはNCLCタグと呼ばれるものですが、YouTubeへのアップロード時にはこのメタデータをYouTube側が解釈するので、アップロード前の確認は欠かせません。

第1回Webセミナー「そのモニターの色、正確ですか?」でメディアファイルのNCLCタグについて解説しています。

詳しくはこちら(EIZO YouTubeチャンネルへ)

例えば、特定の展示会においてHDR映像の表示をする場合など、クローズドなHDRコンテンツの場合には、再生環境でもDaVinci ResolveとビデオI/Oを使うこともあるようです。この場合には、再生環境のDaVinci Resolveでも適切なHDR設定が必要です。私が確認した限りでは、MOV形式ならNCLCメタデータを入力カラースペースとして読み取り反映してくれるようでした。この場合でも、タイムラインカラースペースは手動設定が必要になるので、カラースペースをどのように設定すべきかの申し送りは欠かせません。

YouTubeでのHDR対応

最後に最も手軽に公開できる、YouTubeでのHDR完パケの注意点を簡単に解説したいと思います。これはこの連載執筆時点での情報ですので、時間が経過すると仕様が変わっていく可能性があることをご理解ください。

ここでも完パケの出力では、DaVinci Resolveを活用します。そしてYouTubeへのファイルとして私は低圧縮のPeoRes422LTなどを経由して、アップロードします。アップロードに関しては特別な設定変更は不要です。通常のSDRと同様のワークフローです。

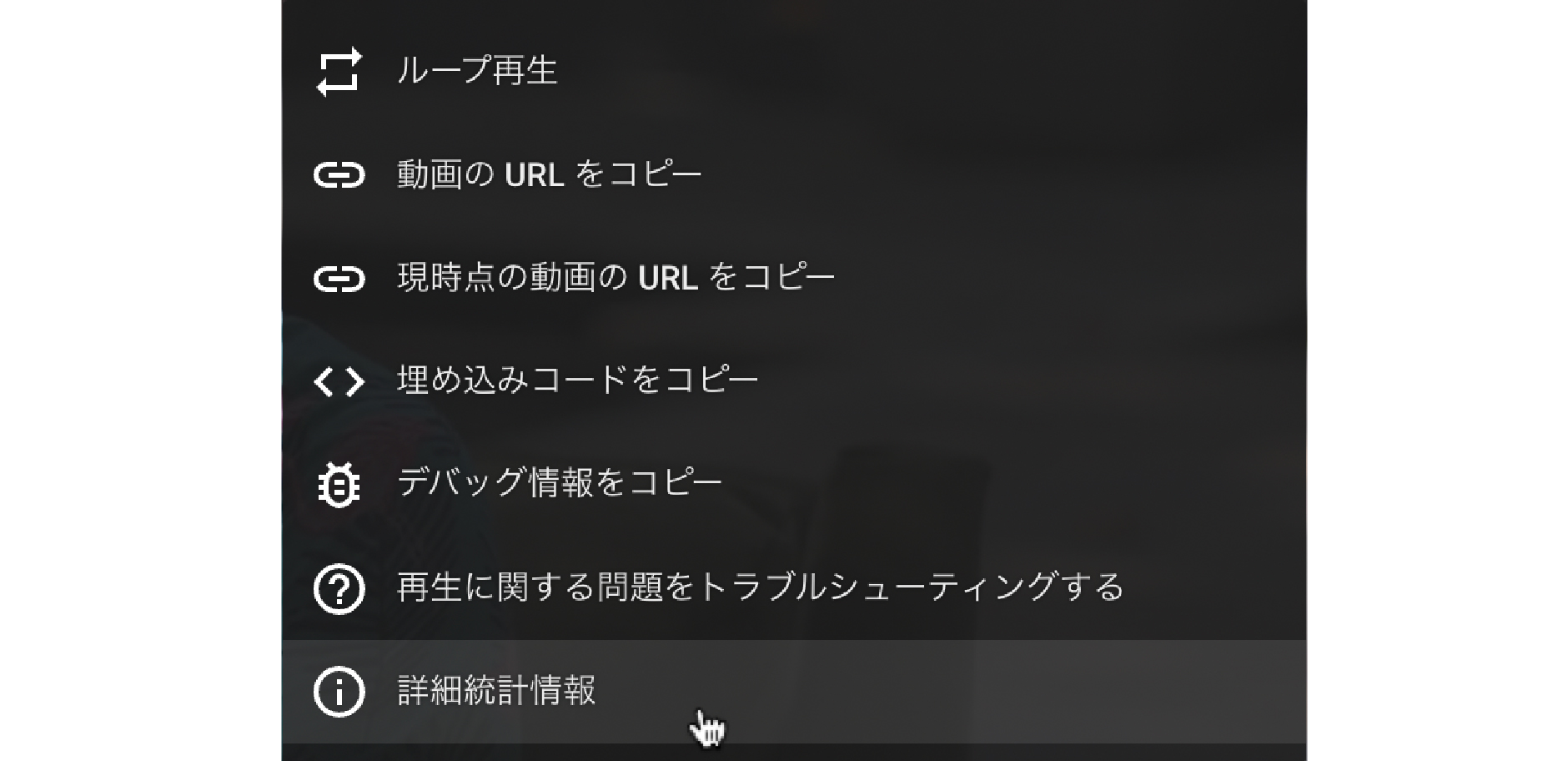

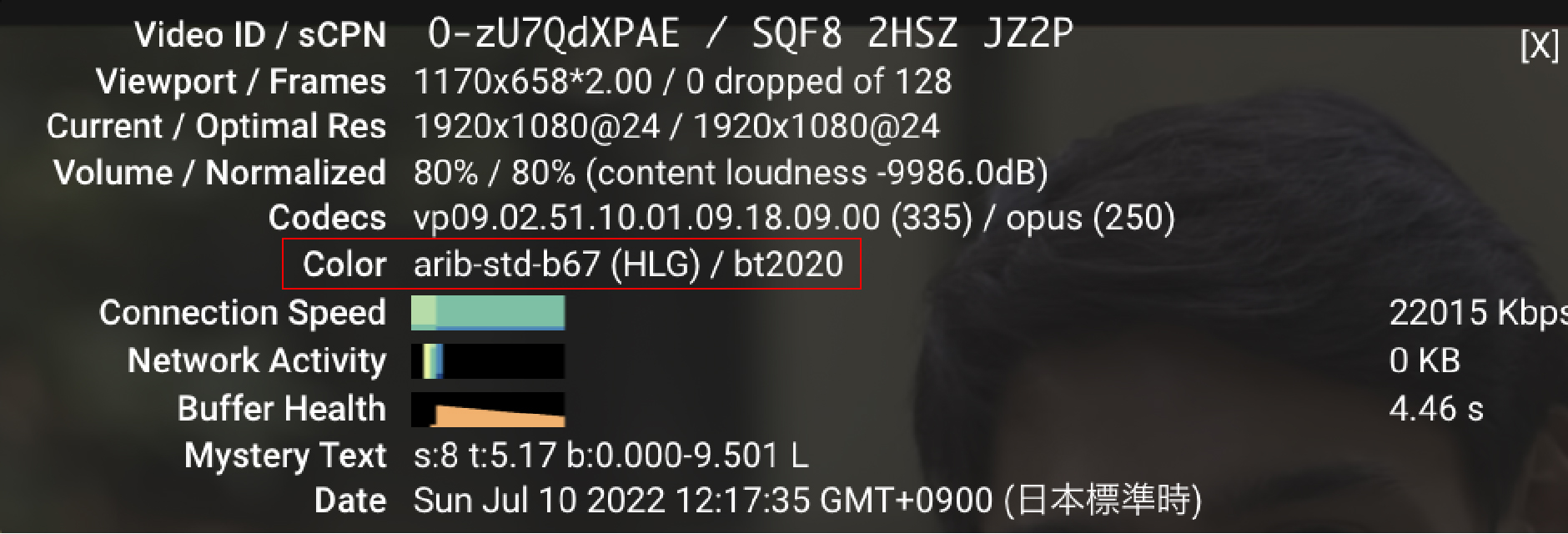

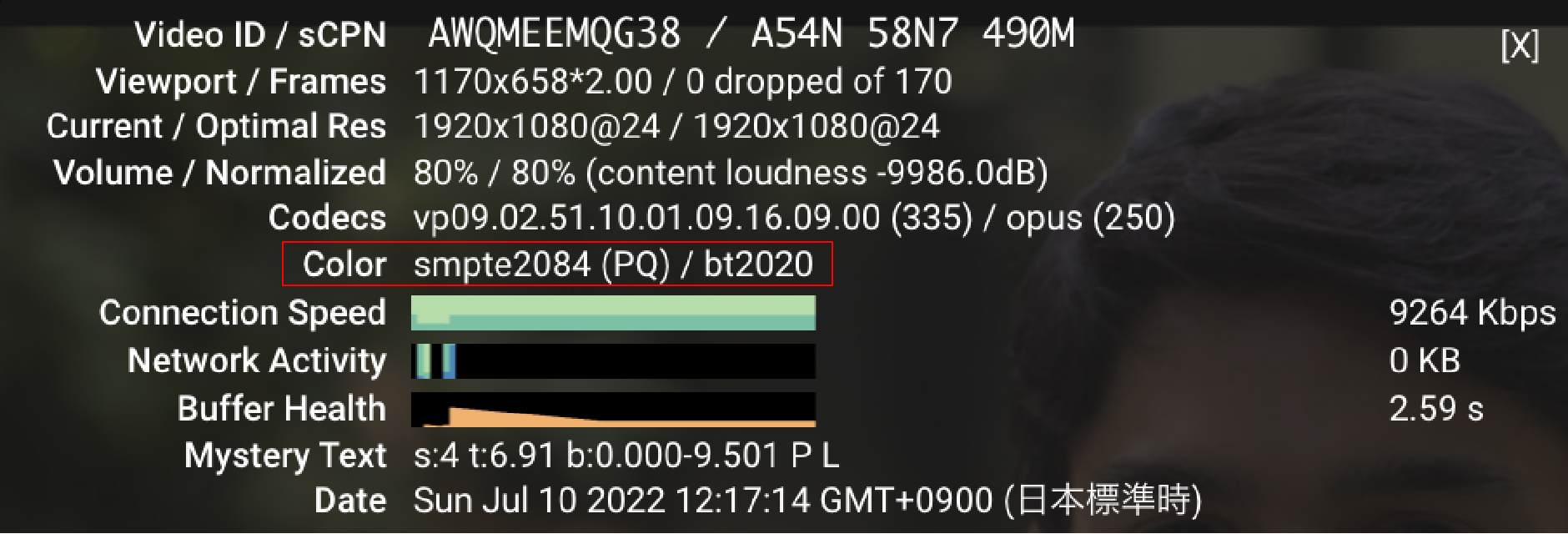

このように、YouTubeでも簡単にHDRコンテンツを公開することができます。私の経験ではSDRコンテンツに比べるとHDRコンテンツの方が映像が反映されるまでに時間が余分にかかっているように感じました。その間は待つだけで、しばらくするとWebブラウザの中でHDR映像が表示できるでしょう。念のため、アップロードしたメディアファイルの仕様を確認してみてください。ビューワを右クリックして統計詳細情報を表示し、Colorの値を確認してください。PQではsmpte2084(PQ) / bt2020、HLGではarib-std-b67(HLG) / bt2020と表示されていれば、HDRとして配信されていることを確認できます。この時に、Webブラウザを表示しているモニターは、当然ながら必ずHDR対応(Macの場合XDR対応)のディスプレイである必要があります。

YouTubeのビューワを右クリックし、詳細統計情報を選択

HLG方式の場合

PQ方式の場合

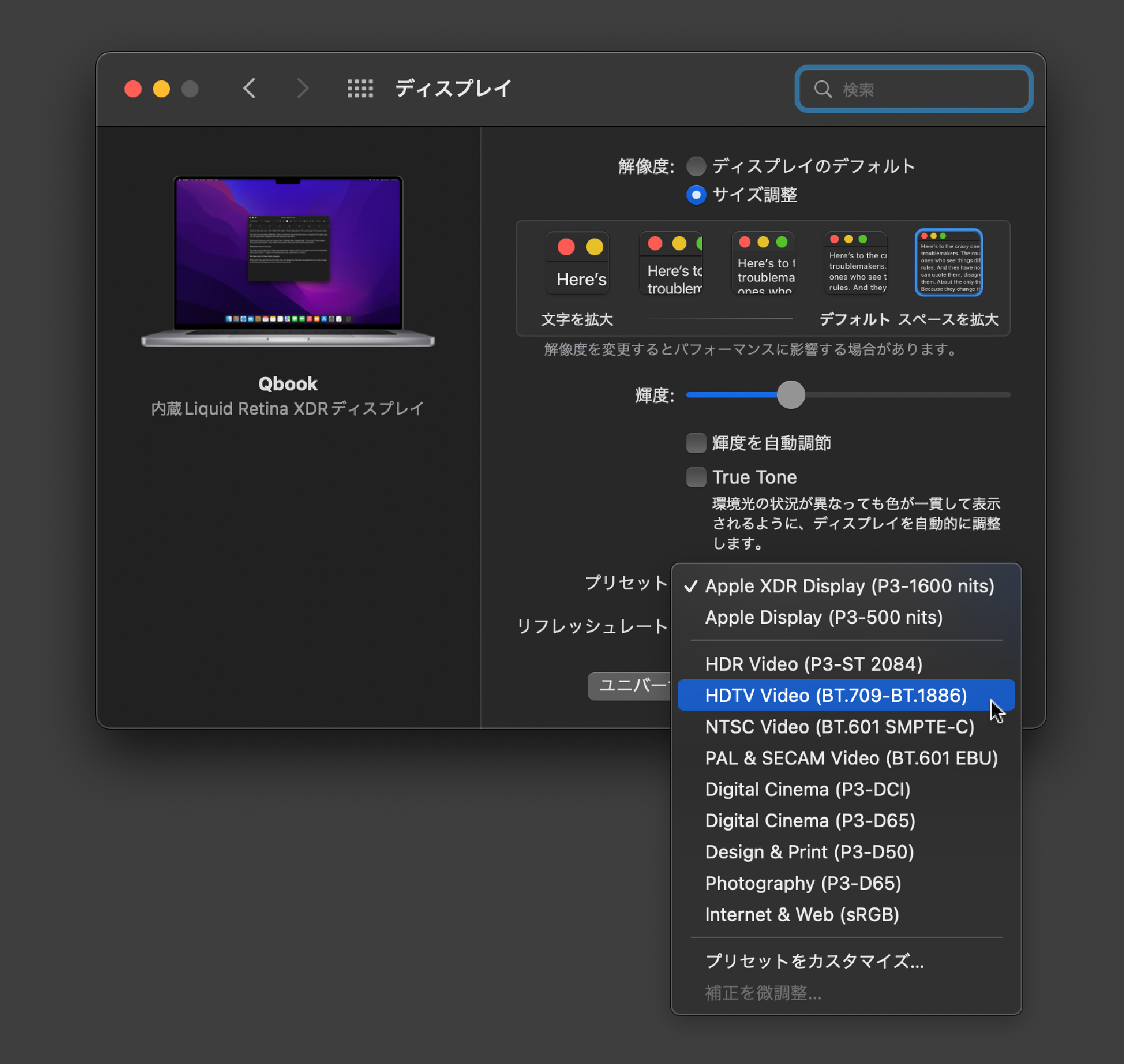

YouTubeでのHDR対応の仕組みは、Macの場合にはシステム環境設定のディスプレイプリセットに依存しているようです。XDRタイプのディスプレイを搭載している環境では、プリセットを「HDTV VIDEO」のようなBT.709系に切り替えると、表示も連動してSDR表示になりました。

Macのシステム環境設定画面

カラーワークフロー連載の最新記事をいち早くお知らせするメールマガジンを発行しています。登録はこちらから

|

Webセミナーのお知らせ

|

|

筆者紹介|山本久之 |

テクニカルディレクター、日本大学藝術学部写真学科講師

テクニカルディレクター、日本大学藝術学部写真学科講師